- В чому різниця між традиційним SEO та оптимізацією під ШІ

- Як провести технічну оптимізацію сайту під штучний інтелект

- Як оптимізувати контент для AI систем

- Off-Page GEO: від посилань до репутації

- Чи варто взагалі оптимізувати сайт під штучний інтелект

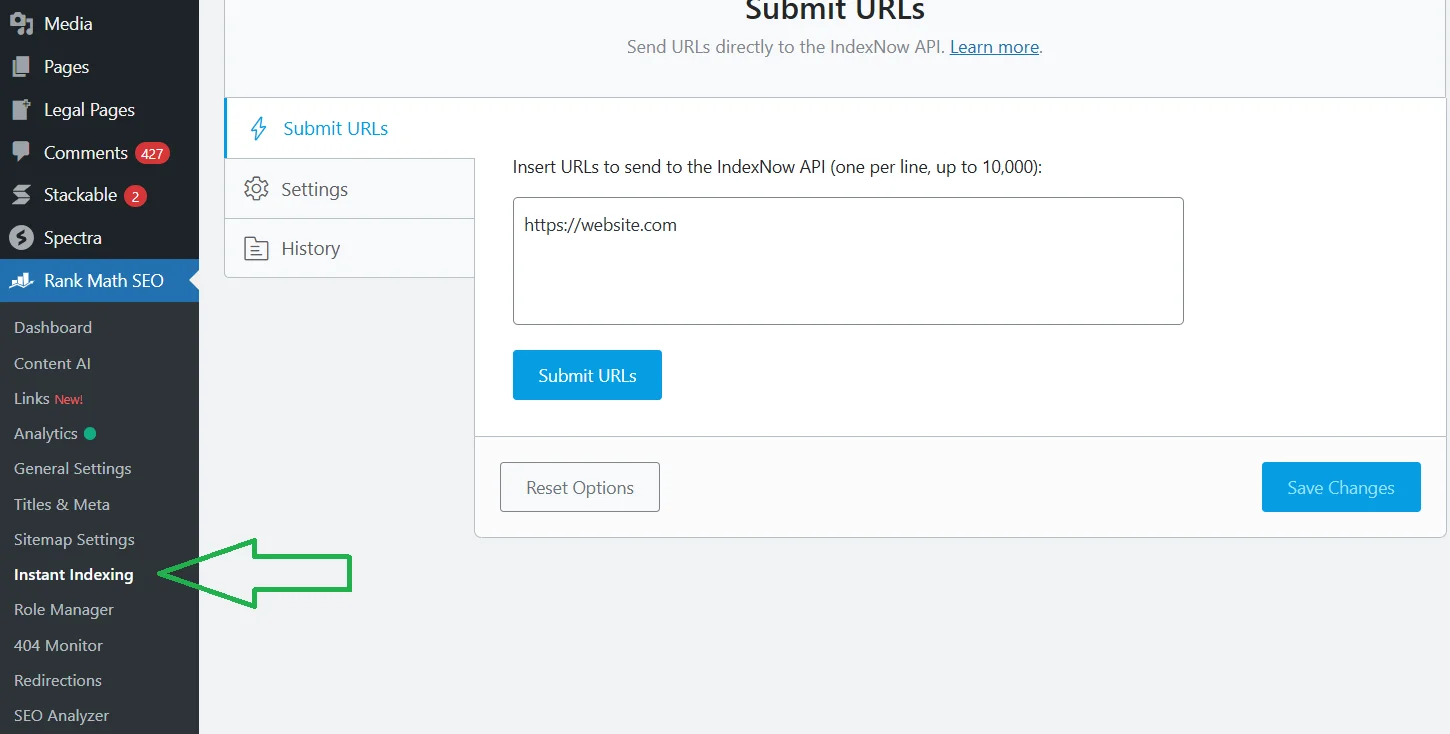

У 2026 році кількість переходів з пошукової видачі на веб-ресурси продовжує падати, блоки AI Overviews з'являються вже у 48% пошукових запитів, а люди миттєво отримують відповіді в ChatGPT, Perplexity, Claude. Тепер доводиться працювати не лише над SEO, а й над GEO, AEO, AIO та іншими типами оптимізації інтернет-проектів. Разом з тим зусилля окуповуються, адже трафік, який все ж приходить із посилань всередині відповідей ШІ, конвертується в покупку в 5 разів ефективніше, ніж звичайний пошуковий. Тож правильний підхід, а саме здатність оптимізувати сайт під ШІ пошук, може привести вам вражаючі результати, про які ви й не могли подумати. Тим паче ключові принципи оптимізації сайтів залишилися незмінними, треба лише навчитися працювати з особливостями ШІ систем.

В чому різниця між традиційним SEO та оптимізацією під ШІ

У класичному SEO треба оптимізувати сайт під ранжування: ви прагнете, щоб ваша сторінка стояла вище за інші в списку результатів, відповідно, було більше шансів, що користувач перейде саме на неї. В оптимізації під штучний інтелект увага сконцентрована на цитувані: ви прагнете, щоб ШІ включив вашу інформацію, бренд, точку зору у свою відповідь.

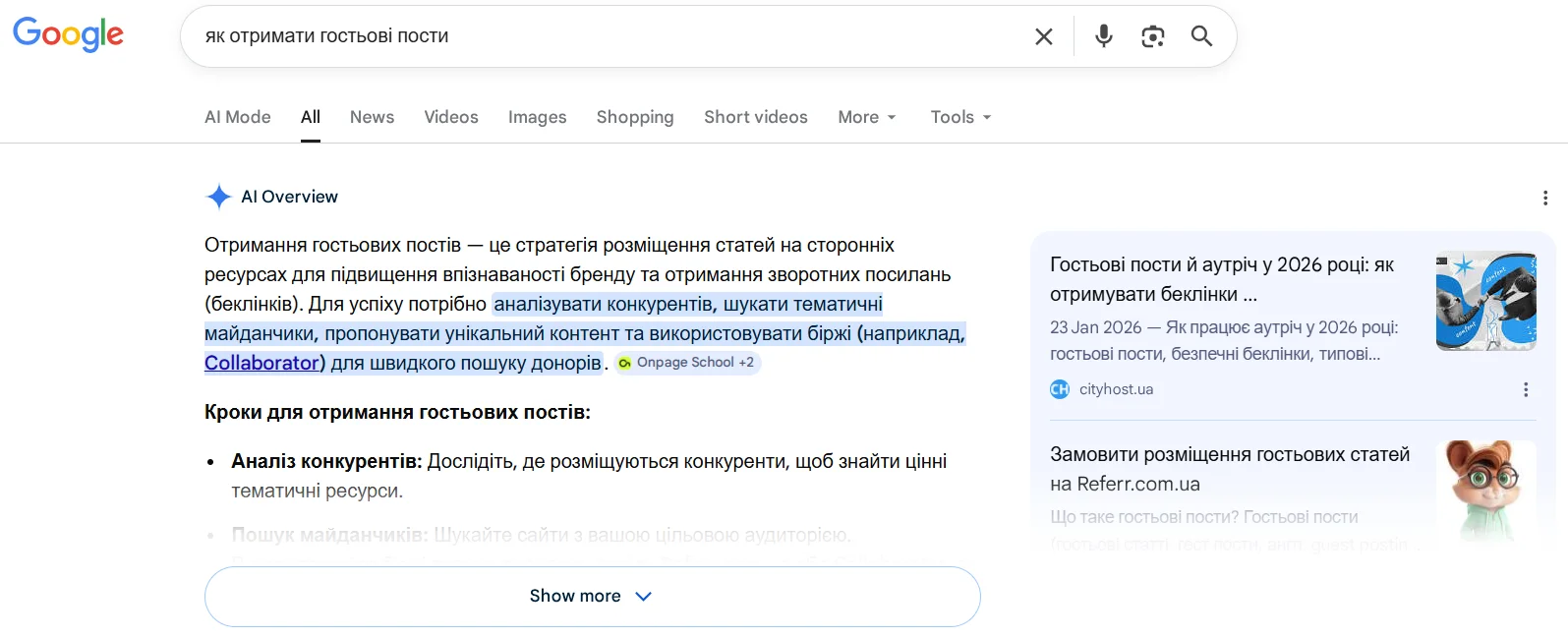

Приклад ТОП джерел від AI Overviews

Різні цілі обумовлені фундаментальними відмінностями у роботі ШІ-ботів та традиційних пошукових краулерів як от Googlebot:

- Традиційні пошукові системи створюють індекс — бібліотеку адрес. Коли користувач вводить запит, боти шукають за індексом та видають список адрес. А сам список та порядок в ньому залежать від відповідності текста введеному запиту та авторитетності самого джерела (з акцентом на зворотні посилання). Тобто краулер не заглиблюється у вивчення вашого тексту — він його класифікує.

- Частина AI систем відповідає виключно з навченої моделі, частина — використовує RAG (Retrieval-Augmented Generation) для відповідей у реальному часі. В другому випадку, коли користувач вводить запит, ШІ робить швидкий пошук, витягує фрагменти тексту з найперспективніших сайтів та віддає їх моделі для написання відповіді. Для власника сайту важливими є обидва сценарії: і потрапити в навчальні дані, і бути джерелом для RAG-витягування.

| Характеристика | Традиційне SEO | Оптимізація під ШІ (GEO/AEO) |

|---|---|---|

| Основний механізм | Індексація та ранжування сторінок | Генерація відповідей на основі RAG |

| Тип запиту | Набір ключових слів (наприклад, «купити машину») | Конверсаційна фраза (наприклад, «яка машина краще для сім'ї з 3 дітьми») |

| Головна мета | Високі позиції в списку посилань для отримання кліків з пошукової видачі | Потрапляння в ШІ-відповідь (ChatGPT, Perplexity, Gemini або AI Overviews) як джерело або цитата. |

| Ключові фактори | Ключові слова, зворотні посилання (backlinks) | Структуровані дані (Schema), авторитетність (E-E-A-T), релевантність контексту та цитування. |

| Формат контенту | Статті, оптимізовані під конкретні пошукові запити. | Чіткі факти, прямі відповіді на питання, глибока експертиза та живі кейси. |

Важливим моментом є не лише різниця у принципі роботі ботів та кінцевій меті власника сайту, а й у місцях надання відповіді. Якщо в SEO ми оптимізуємо сторінки, щоб вони потрапили в пошукову видачу (Google, Bing, Yahoo!), то при роботі зі штучним інтелектом нам треба, щоб веб-ресурс цитували і у пошуковій видачі, і в конкретних чат-ботах. Звідси походить велика плутанина у термінах, а саме — GEO, AIO, AEO.

Попри важливі відмінності, SEO та AI поступово зближуються. Вимоги пошукових ботів стають все більш схожими на ШІ ботів: чіткі відповіді на запити користувачів, власний досвід, глибоке розуміння теми, структуровані дані, посилання з авторитетних джерел, а не просто сотні беклінків з каталогів. Наприклад, стаття Cityhost про вибір VPS сервера займає перше місце у видачі Гугл та друге в AI Overview. При її написанні Богдана Гайворонська та Андрій Заровінський якраз і брали ключові моменти зі стандартної пошукової оптимізації сайтів, додавали до них сучасні вимоги пошуковиків та грамотно поєднували з особливостями штучного інтелекту.

Читайте також: Штучний інтелект — друг, коханець, психолог

Як провести технічну оптимізацію сайту під штучний інтелект

Для штучного інтелекту robots.txt, карта сайту, швидкість сторінок, чистота коду, відсутність дублів, адаптивність під мобільні пристрої, високий рівень захисту такі ж важливі як і для пошукових систем. З розвитком ШІ ще більш важливою стала розмітка, адже її відсутність або неправильне налаштування може стати головною перешкодою на шляху до цитування AI системами. А у 2024 році ще й додався стандарт llms.txt, який допомагає ШІ отримати ключову інформацію про інтернет-проект.

- Базова технічна оптимізація під штучний інтелект

- Особливі вимоги до Robots.txt у 2026 році

- Як створити файл llms.txt для штучного інтелекту

- Як налаштувати мікророзмітку Schema.org для AI систем

Базова технічна оптимізація під штучний інтелект

Технічна оптимізація під штучний інтелект майже повністю збігається з класичним SEO — і це хороша новина. Якщо сайт технічно здоровий з точки зору Google, він вже наполовину готовий до AI-видимості. Різниця — у кількох нових вимогах та зміщенні пріоритетів:

- Core Web Vitals. Час завантаження найбільшого видимого елементу LCP має бути менше 2.5 секунд. Час відповіді сторінки на дію користувача не має перевищувати 200 мс. А часове вікно для зміщення макета під час підвантаження важких елементів може бути максимум 1 секунду. В блозі Cityhost є корисний матеріал про основні метрики швидкості завантаження сайту, які важливі і для SEO, і для GEO.

- Карта сайту. Основна вимога залишилася — наявність файлу sitemap.xml у корені сайту з реєстрацією у Google Search Console та Bing Webmaster Tools. Але Perplexity та деякі інші AI-системи використовують sitemap для первинного обходу веб-ресурсу перед індексацією, тому карта має миттєво оновлюватися при публікації нового контенту, не містити видалених або редиректних URL. Якщо сайт на WordPress, радимо використовувати Rank Math або Yoast, які є найкращими SEO плагінами з усім необхідним функціоналом для sitemap.xml.

- Безпека. Протокол HTTPS залишається критичним фактором ранжування, відповідно, SSL сертифікат — це обов'язкова умова для успішного просування в пошукових та AI системах.

- Чистота коду. Навіть тут ШІ трохи підвищив вимоги, адже багато ботів не здатні виконувати скрипти. Краще відмовитися від складного клієнтського JavaScript (CSR) на користь серверного рендерингу (SSR).

- Мобільна адаптивність. Вже давно важливо адаптувати сайт для мобільних пристроїв, але мова йде не лише про використання правильних шаблонів або верстки. Перевіряйте кожну сторінку на різних пристроях, адже часто веб-ресурс адаптований професійно, а конкретна сторінка відображається некоректно на смартфоні чи планшеті через специфічні блоки чи інтерактивні елементи.

- Биті посилання. Постійно перевіряйте сайт через Screaming Frog (безкоштовно до 500 URL) або Ahrefs Webmaster Tools на відсутність внутрішніх посилань, що ведуть на неіснуючі сторінки. У 2026 році основними типами дублів є канонічні та параметричні, а також дублі категорій та тегів, які часто зустрічаються на WordPress.

- Редиректи. Їх використання є нормальною практикою, але за відсутності ланцюгів, коли URL веде через 2-3 проміжні адреси до фінальної. Завжди має бути лише один редирект, тобто стара адреса відразу веде користувача на нову.

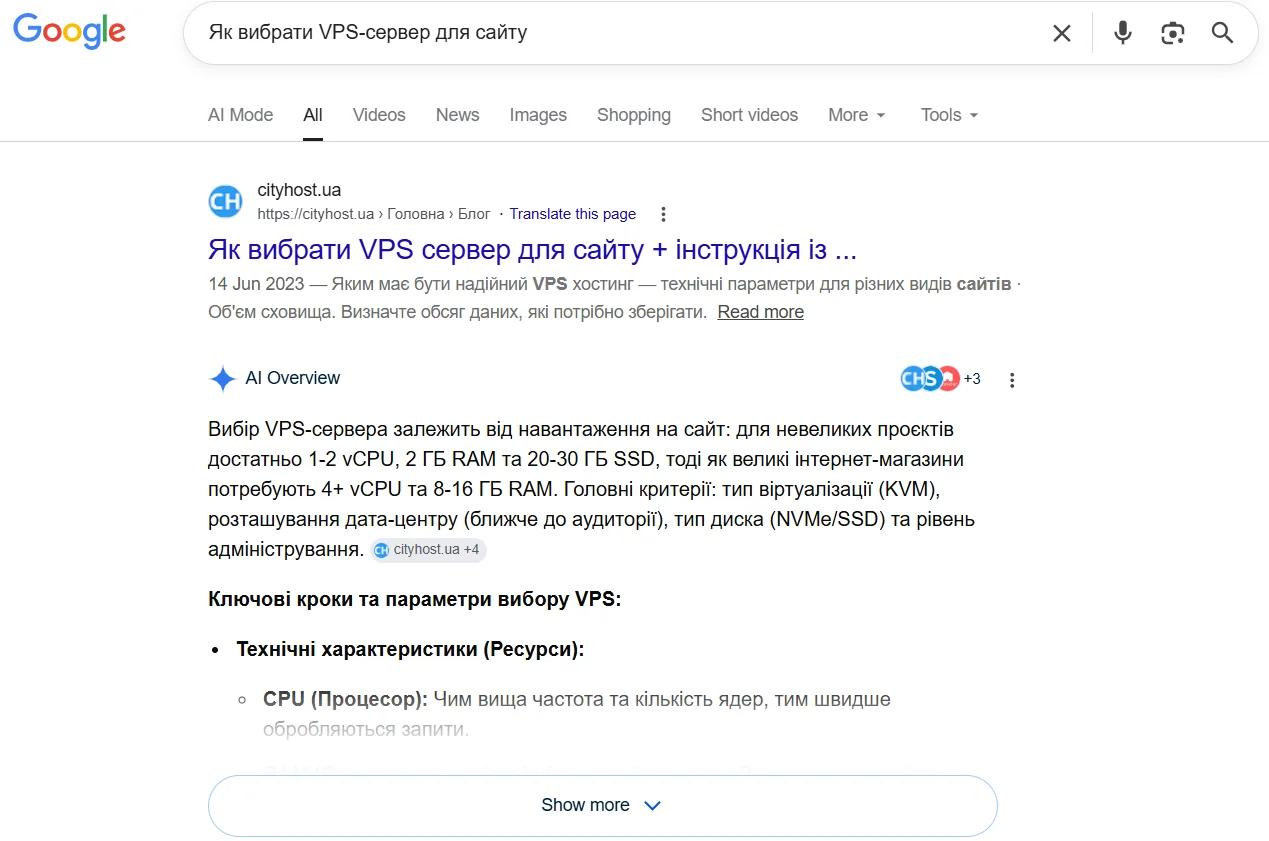

Окремо хочу виділити IndexNow — стандарт для миттєвого повідомлення як пошукових, так і AI систем про оновлення контенту. Для власників сайтів на WordPress є комплексні SEO плагіни з підтримкою цього протоколу. Наприклад, я використовую безкоштовну версію Rank Math, який підтримує миттєву індексацію як кожної сторінки окремо, так і великої кількості разом (до 10 000).

В розділі Rank Math → Instant Indexing спочатку вказуєте список URL (кожна з нового рядка), потім подаєте їх на індексацію та зберігаєте зміни.

Особливі вимоги до Robots.txt у 2026 році

Створити файл robots.txt можна за декілька хвилин за допомогою онлайн-сервісів та WordPress плагінів на кшталт Rank Math, Yoast, All-in-One. Але для оптимізації сайту під штучний інтелект класичного наповнення недостатньо. Треба вміти чітко розрізняти ботів для навчання та ботів для живого пошуку, щоб випадково не заблокувати доступ до контенту корисним ШІ системам.

Вам треба перевірити, чи дозволені наступні AI боти в robots.txt:

- Google-Extended — Gemini;

- ClaudeBot — Anthropic (Claude);

- PerplexityBot — Perplexity;

- ChatGPT-User та OAI-SearchBot — ChatGPT (саме для користувачів).

Багато сайтів блокують вищеописаних ботів за замовчуванням через налаштування безпеки, наприклад, у Cloudflare. Щоб відкрити їм доступ, пропишіть у файлі robots.txt назви ботів через «Allow: /».

Деяких ШІ ботів, які збирають дані для навчання, навпаки краще заблокувати:

- GPTBot;

- Google-CloudVertexBot;

- Bytespider;

- CCBot;

- meta-externalagent;

- Amazon-bot (якщо ви не продаєте товари на Amazon та не маєте користі від Alexa).

Заблокувати їм доступ можна теж у файлі robots.txt через «Disallow: /». Тільки важливо розуміти, що цей файл є лише рекомендацією: великі корпорації зазвичай дотримуються цих правил, а Bytespider та схожі боти — ігнорують. Однак краще закрити їм доступ, та додатково себе захистити, наприклад, з тим же Cloudflare.

Як створити файл llms.txt для штучного інтелекту

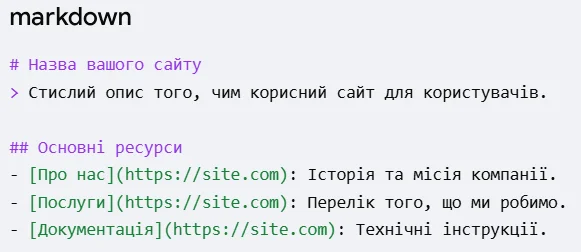

Створити цей файл можна в стандартному текстовому редакторі, наприклад, Notepad або VS Code. Документ треба називати саме llms.txt, а не LLMS.txt. В ньому слід прописати:

- # Назва проекту — основний заголовок.

- > Короткий опис — суть сайту.

- ## Розділи.

Потім зберігаєте файл та розміщуєте у кореневій папці сайту, де вже знаходиться robots.txt. І відразу можете його перевірити за адресою вашсайт.com/llms.txt. Якщо ж проект великий, тоді можна створити llms-full.txt, де розмістити набагато більше посилань та детальної інформації, тоді як основний llms.txt залишити як лаконічний вступ.

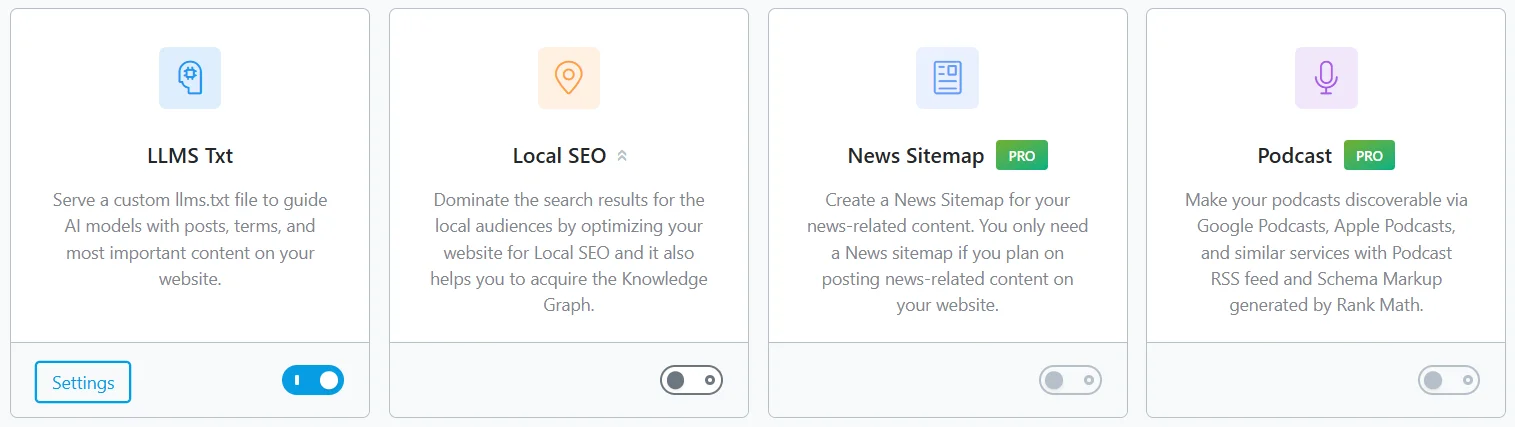

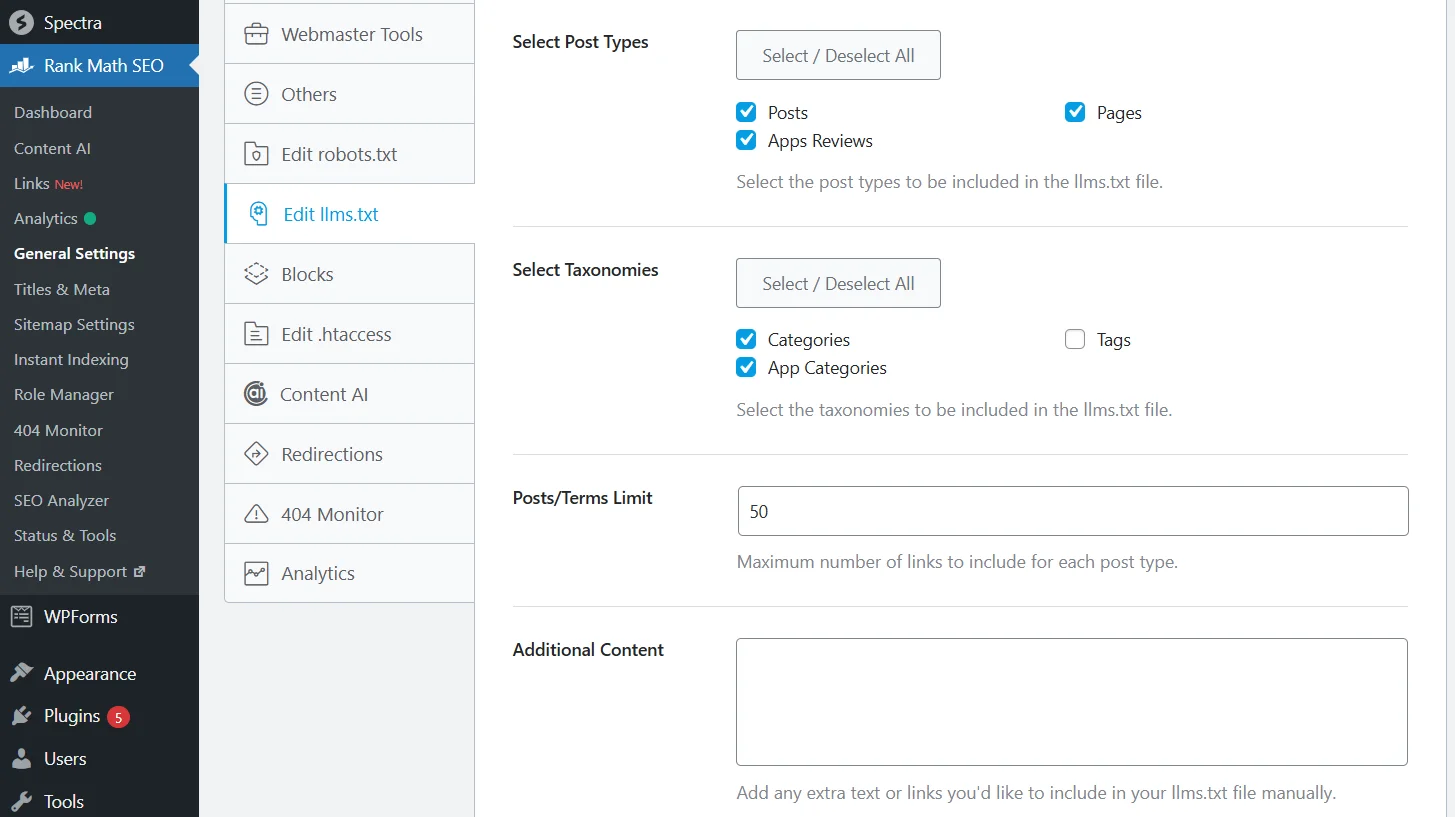

Для WordPress є безліч плагінів для автоматичного створення llms.txt, враховуючи LLMs.txt Generator та Website LLMs.txt. До того ж класичні плагіни для пошукової оптимізації сайту теж підтримують цей файл. Я використовую саме модуль для Rank Math — LLMS Txt.

Модуль доступний в безкоштовній версії з миттєвою активацією.

LLMS Txt від Rank Math підтримує як стандартні, так і кастомні типи записів.

Як налаштувати мікророзмітку Schema.org для AI систем

У класичному SEO Schema допомагала отримати розширені сніпети у видачі, щоб виділитися серед конкурентів. В епоху штучного інтелекту мікророзмітка стала ще важливішою, адже дозволяє AI однозначно розуміти тип контенту.

До основних типів Schema відноситься:

- FAQPage — пряме джерело для формування відповідей ШІ, відповідно, найкращий спосіб отримувати згадки та посилання з відповідей штучного інтелекту.

- Organization — встановлює ідентичність бренду, враховуючи логотип, контакти та соцмережі компанії.

- Article — стандартна мікророзмітка для записів, яка обов'язково має містити поля dateModified (ШІ звертає особливу увагу на актуальність даних) та author з посиланням на профіль експерта.

- Review — корисна розмітка, яку я використовую для оглядів.

- Product — надзвичайно важлива для e-commerce, адже дозволяє ШІ витягувати дані про ціну, наявність та відгуки для порівняння товарів.

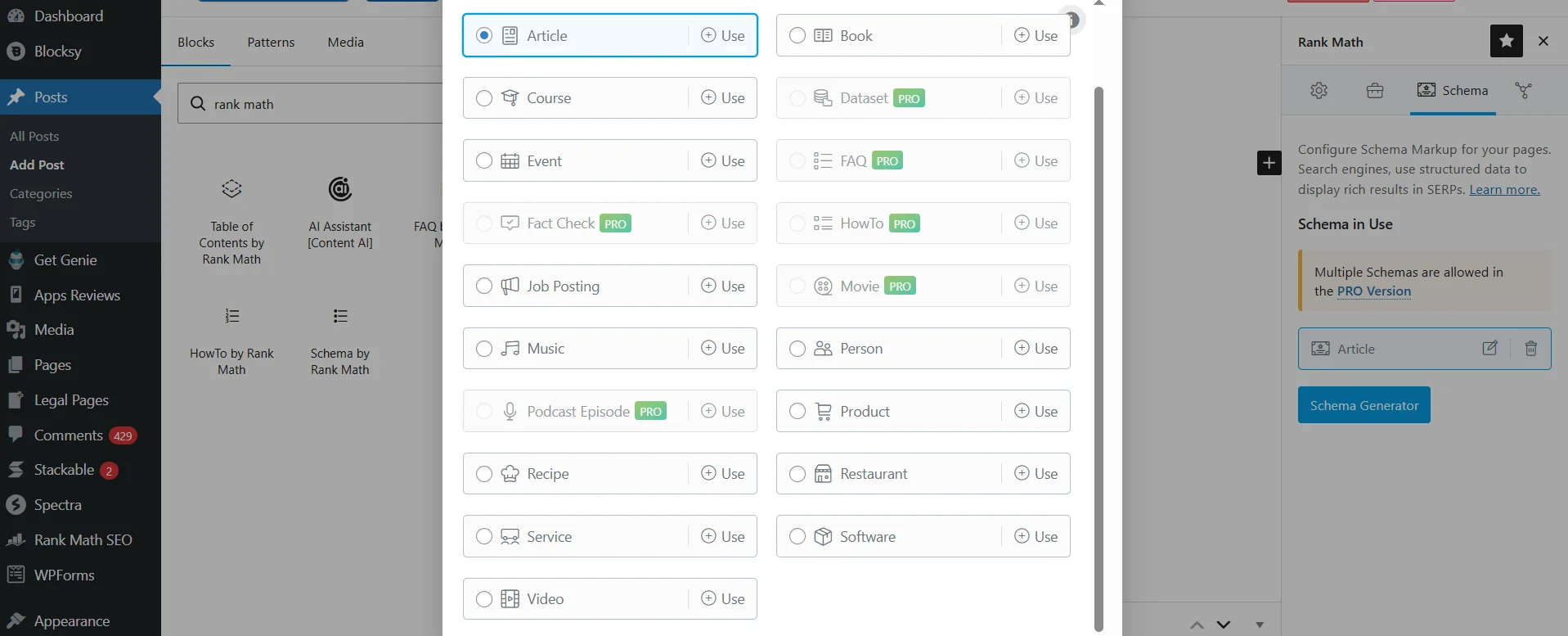

Для генерації мікророзмітки можна використовувати офіційний інструмент Schema.org Generator. Якщо хочете спростити процес, тоді варто використати один з популярних SEO плагінів, наприклад, той же Rank Math.

Однак тут вже доведеться зіштовхнутися з обмеженнями безкоштовної версії: частина схем доступна лише в платній версії, плюс чисто технічно не можна додати 2-3 та більше розміток. Але, якщо вставляти, наприклад, питання та відповіді через FAQ by Rank Math прямо на сторінку, то все налаштовується та індексується. Тільки не забувайте перевіряти результати у Rich Results Test, щоб переконатися, що дані зчитуються правильно.

Читайте також: Найкращі ШІ-сервіси для SEO: оптимізація сайту без зайвих зусиль

Як оптимізувати контент для AI систем

Для створення контенту, який будуть цитувати ШІ системи треба переходити від думки «Які ключові слова вводять люди?» до «Які питання ставлять користувачі — і яку точну відповідь вони очікують?». Ваша мета — створити автономний блок тексту, який штучний інтелект зможе вилучити зі сторінки та вставити у відповідь користувачу без виправлень.

Для цього слід використовувати сучасну структуру контенту:

- Заголовок H2 у формі поширеного запиту користувачів. Наприклад, «Як розрахувати потужність кондиціонера?».

- Пряма відповідь одразу під заголовком, без довгих вступів. Наприклад, «Площу кімнати треба розділити на 10. Відповідно, якщо це кімната 20 м², потрібен кондиціонер на 2 кВт, 40 м² — 4 кВт».

- Глибока деталізація, де ви вже додаєте унікальні дані, власні кейси або професійні нюанси. Наприклад, «Для кращої точності не слід ігнорувати додаткові джерела тепла. З власного досвіду можу сказати, що додавання по 0.1 кВт на кожну людину та 0.5 кВт на техніку дозволяє…».

Окрім структури блоків, важливо як виглядає сам текст. ШІ системи значно легше обробляють та частыше цитують матеріали, які містять абзаци з 3-5 речень, нумеровані та маркеровані списки, таблиці.

Чому власний досвід став обов'язковою вимогою

У 2023-2025 роках AI системи зіткнулися з масовим потоком однотипного контенту, згенерованого самим же ШІ. У відповідь моделі почали надавати явну перевагу джерелам із сигналами реального людського досвіду. Саме тому, попри важливість конкретики, особливо в першому абзаці після підзаголовка, ваш сайт немає ставати довідником, адже такі веб-ресурси просто не витримають конкуренції зі штучним інтелектом.

Навпаки особистий досвід зараз є критично важливим як для людей, так і для ШІ. Це підтверджується концепцією E-E-A-T, де перша «E» — Experience (досвід) — з'явилась у 2022 році саме як відповідь Google на зростання безособового контенту. Штучний інтелект взяв цей же принцип відбору надійних джерел для цитування: матеріал без автора та без досвіду не може вважатися надійним джерелом.

Показати свій досвід та експертність на сайті можна за допомогою:

- Сторінки автора. Тепер недостатньо поставити просто ім'я під статтею. Важливо, щоб автор мав окрему сторінку, де вказана його спеціалізація, досвід, освіта, приклади реальних проектів або публікацій.

- Підпису автора. Під кожним матеріалом має бути блок автора з фотографією, ім'ям, коротким біо та посиланням на цю сторінку. І це стосується не лише блогів чи онлайн журналів, а й компаній: виберіть декількох членів команди, створіть їм профілі та публікуйте від їх імені.

- Першої особи. Як я вже казав, не треба робити зі статті ваш особистий щоденник, але там, де це доречно — слід показати досвід. Наприклад, «Я місяць тестував 5 хостинг-провайдерів та вибрав найкращий надійний недорогий хостинг для сайту» або «Цей повербанк в мене падав десятки разів, а ззовні як новий».

- Дати публікації та оновлення. AI системи, що працюють у режимі реального часу враховують актуальність джерела. Стаття, яку оновили 3 місяці тому, отримає пріоритет над матеріалом з останнім оновленням у 2023 році.

Тож контент, який цитує ШІ, будується на перетині трьох речей: чіткої структури для швидкого витягування відповідей, реального досвіду як сигналу надійності джерела, живого авторського голосу, за яким люди хочуть повертатися на сайт.

Читайте також: Що таке tone of voice — яким тоном бренду говорити зі своєю аудиторією

Off-Page GEO: від посилань до репутації

За останні два роки відбулися важливі зміни у підході до зовнішньої оптимізації з боку як пошукових систем, так і штучного інтелекту. Раніше посилання виконувало одну функцію — передавало «вагу» від одного домену до іншого, а алгоритм рахував кількість та якість цих зв'язків. У 2026 році посилання залишаються важливими, але для ШІ вони є радше одним з доказів надійності джерела, ніж ключовим критерієм для його вибору.

В результаті вже відомі типи Off-Page SEO стали однаково важливими для штучного інтелекту:

- Згадки бренду. Коли авторитетне видання пише «за даними Cityhost» або «як зазначає контент-маркетолог Cityhost Богдана Гайворонська» — AI системи фіксують це як сигнал впізнаваності та надійності бренду. І одна така згадка без лінку є важливішою, ніж 10 слабких беклінків.

- Цитування на веб-ресурсах з високим авторитетом домену. Беклінки з профільних видань з DA 70+ важливі як і раніше, але їх цінність суттєво зросла. Краще отримати декілька таких лінків, ніж сотні з каталогів.

- Авторитетність автора. У класичному SEO авторитетність домену та автора були фактично одним і тим самим. В GEO — це два різних сигнали, і обидва важливі. Якщо вашого автора десь цитують або він пише статті під своїм ім'ям для інших видань, то його контент на вашому сайті може мати чудовий буст.

Отримувати згадки сайту можна на Reddit та Quora, приймаючи участь у профільних обговореннях та відповідаючи на тематичні запитання. Ефективним майданчиком для отримання і посилальної ваги, і тематичного цитування є Medium: створюєте акаунт та пишете статті на схожі до вашого сайту теми, а всередині вставляєте посилання (краще не спамте, одного-двох достатньо) та згадуєте свій інтернет-проект або компанію. Хоча українська спільнота на Medium постійно збільшується, але конкуренція все одно низька, особливо порівняно з англомовним сегментом.

Чи варто взагалі оптимізувати сайт під штучний інтелект

Так, але не робити з цього щось грандіозне, паралельно панікуючи, що «SEO вмирає». Воно вмирає ще з 2003 року, коли Гугл ввів Florida Update та з 2011 року з Panda Update — почав боротьбу з дубльованим та слабким контентом. І за останні роки відбулося багато змін та нових апдейтів, штучний інтелект дійсно забрав велику частку трафіку, але разом з тим приніс вищу якість.

Згідно з даними Superprompt за 2025 рік, AI пошук конвертує набагато краще, ніж традиційний органічний пошук. Наприклад, конверсія з Google в середньому становить 2.8%, тоді як Perplexity — 12.4%, ChatGPT — 14.2%, а Claude — 16.8%. Користувач, який прийшов до вас через Perplexity або ChatGPT, у п'ять разів частіше зробить цільову дію, наприклад, купить товар або скористається послугою, ніж людина з Google.

Однак цікаво те, що хороше класичне SEO досі є найкращою стратегією потрапляння в AI відповідь: згідно з даними Ahrefs за 2025 рік, 76.1% URL, які цитуються в Google AI Overviews, також ранжуються в ТОП 10 Гугл за тим же запитом. Тобто сам фундамент у вигляді пошукової оптимізації сайтів залишається, а до нього додаються специфічні вимоги ШІ систем, про які ми вже говорили:

- Технічна база майже не змінилася. Індексація, швидкість, структура — все ще критично важливі.

- Контент став більш структурованим та складним — від ключових слів до намірів і питань, від анонімного тексту до верифікованого авторського досвіду.

- Зовнішнє SEO змістилося з «беклінків як збільшення посилальної ваги» до «зворотних посилань як підвищення авторитету сайту».

Ключові принципи (авторитетність, структура, досвід, технічна доступність) працюють на всіх платформах одночасно, будь то Google, ChatGPT чи Claude. Вони всі вирішують одне й те саме завдання: знайти надійне джерело для відповіді на запит людини. Якщо ви будете зрозумілим та корисним для своєї цільової аудиторії, а головне — готовим поділитися власним досвідом, то зможете отримувати трафік і з пошуковиків, і з AI систем.