- В чем разница между традиционным SEO и оптимизацией под ИИ

- Как провести техническую оптимизацию сайта под искусственный интеллект

- Как оптимизировать контент для ИИ систем

- Off-Page GEO: от ссылок до репутации

- Стоит ли вообще оптимизировать сайт под искусственный интеллект

В 2026 году количество переходов из поисковой выдачи на веб-ресурсы продолжает падать, блоки AI Overviews появляются уже в 48% поисковых запросов, а люди мгновенно получают ответы в ChatGPT, Perplexity, Claude. Теперь приходится работать не только над SEO, но и над GEO, AEO, AIO и другими типами оптимизации интернет-проектов. Вместе с тем усилия окупаются, ведь трафик, который все же приходит из ссылок внутри ответов ИИ, конвертируется в покупку в 5 раз эффективнее, чем обычный поисковый. Так что правильный подход, а именно способность оптимизировать сайт под ИИ поиск, может привести вас к впечатляющим результатам, о которых вы и не могли подумать. Тем более ключевые принципы оптимизации сайтов остались неизменными, нужно лишь научиться работать с особенностями ИИ систем.

В чем разница между традиционным SEO и оптимизацией под ИИ

В классическом SEO нужно оптимизировать сайт под ранжирование: вы стремитесь, чтобы ваша страница стояла выше других в списке результатов, соответственно, было больше шансов, что пользователь перейдет именно на нее. В оптимизации под искусственный интеллект внимание сконцентрировано на цитировании: вы стремитесь, чтобы ИИ включил вашу информацию, бренд, точку зрения в свой ответ.

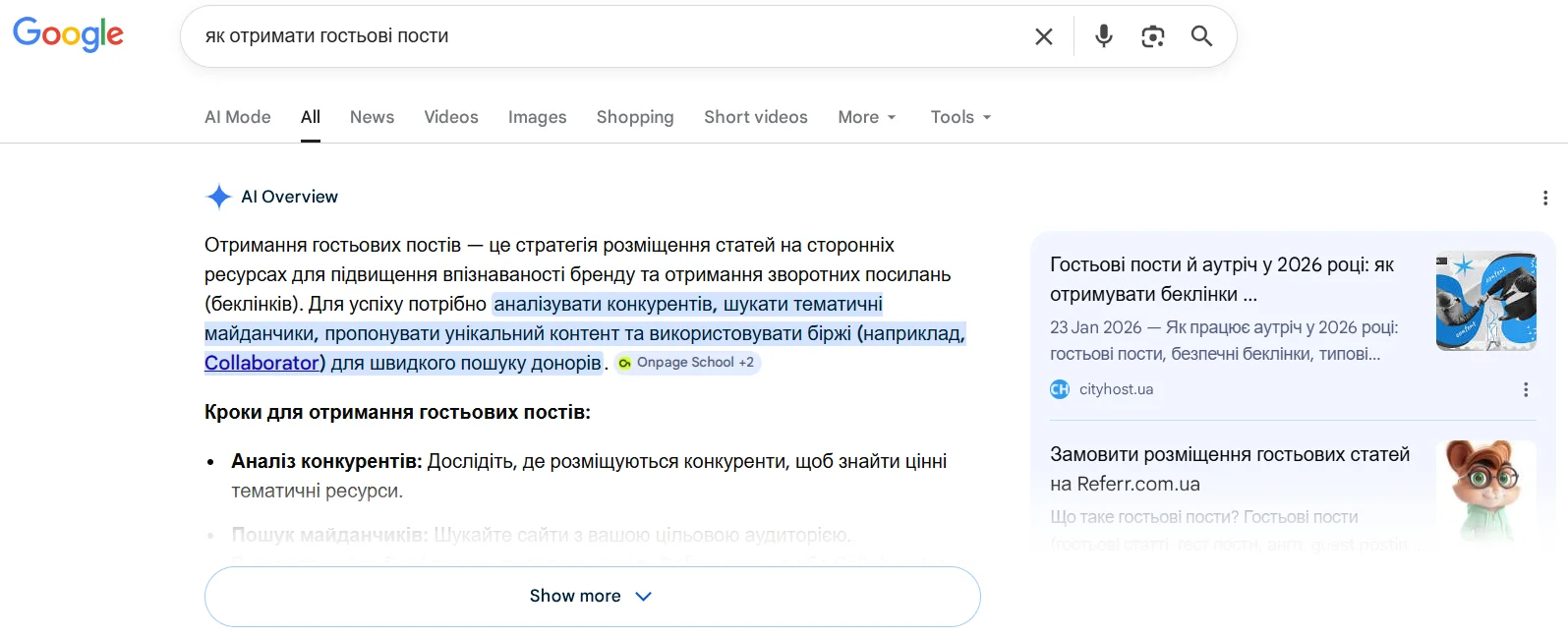

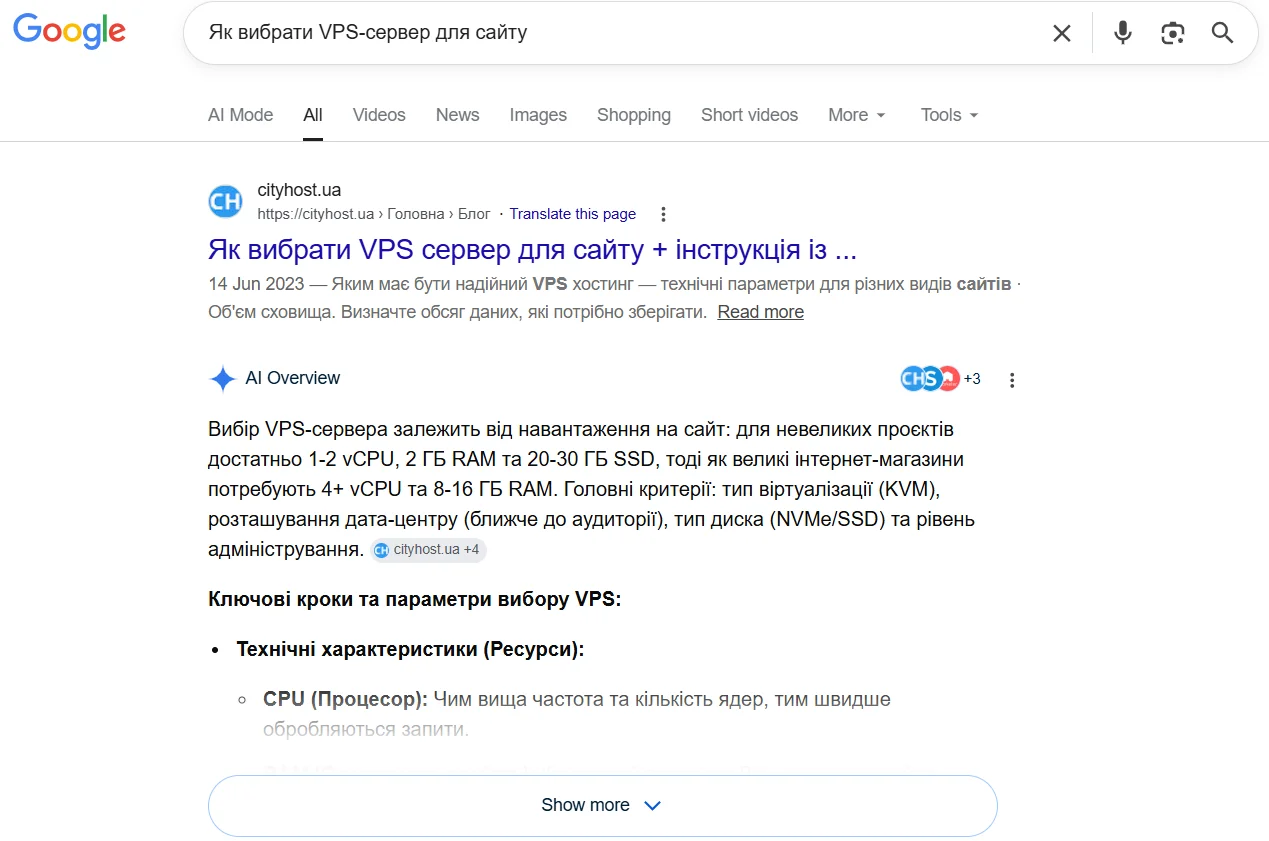

Пример ТОП источников от AI Overviews

Разные цели обусловлены фундаментальными отличиями в работе ИИ-ботов и традиционных поисковых краулеров, таких как Googlebot:

- Традиционные поисковые системы создают индекс — библиотеку адресов. Когда пользователь вводит запрос, боты ищут по индексу и выдают список адресов. А сам список и порядок в нем зависят от соответствия текста введенному запросу и авторитетности самого источника (с акцентом на обратные ссылки). То есть краулер не углубляется в изучение вашего текста — он его классифицирует.

- Часть ИИ систем отвечает исключительно из обученной модели, часть — использует RAG (Retrieval-Augmented Generation) для ответов в реальном времени. Во втором случае, когда пользователь вводит запрос, ИИ делает быстрый поиск, берет фрагменты текста с наиболее перспективных сайтов и отдает их модели для написания ответа. Для владельца сайта важны оба сценария: и попасть в обучающие данные, и быть источником для RAG-извлечения.

| Характеристика | Традиционное SEO | Оптимизация под ИИ (GEO/AEO) |

|---|---|---|

| Основной механизм | Индексация и ранжирование страниц | Генерация ответов на основе RAG |

| Тип запроса | Набор ключевых слов (например, «купить машину») | Конверсационная фраза (например, «какая машина лучше для семьи с 3 детьми») |

| Главная цель | Высокие позиции в списке ссылок для получения кликов из поисковой выдачи | Попадание в ИИ-ответ (ChatGPT, Perplexity, Gemini или AI Overviews) как источник или цитата. |

| Ключевые факторы | Ключевые слова, обратные ссылки (backlinks) | Структурированные данные (Schema), авторитетность (E-E-A-T), релевантность контекста и цитирование. |

| Формат контента | Статьи, оптимизированные под конкретные поисковые запросы. | Четкие факты, прямые ответы на вопросы, глубокая экспертиза и живые кейсы. |

Важным моментом является не только разница в принципе работы ботов и конечной цели владельца сайта, а и в местах предоставления ответа. Если в SEO мы оптимизируем страницы, чтобы они попали в поисковую выдачу (Google, Bing, Yahoo!), то при работе с искусственным интеллектом нам нужно, чтобы веб-ресурс цитировали и в поисковой выдаче, и в конкретных чат-ботах. Отсюда возникает большая путаница в терминах, а именно — GEO, AIO, AEO.

Несмотря на важные отличия, SEO и ИИ постепенно сближаются. Требования поисковых ботов становятся все более похожими на ИИ ботов: четкие ответы на запросы пользователей, личный опыт, глубокое понимание темы, структурированные данные, ссылки с авторитетных источников, а не просто сотни беклинков из каталогов. Например, статья Cityhost о выборе VPS сервера занимает первое место в выдаче Google и второе в AI Overview. При ее написании Богдана Гайворонская и Андрей Заровинский как раз и брали ключевые моменты из стандартной поисковой оптимизации сайтов, добавляли к ним современные требования поисковиков и грамотно сочетали с особенностями искусственного интеллекта.

Читайте также: Искусственный интеллект — друг, любовник, психолог

Как провести техническую оптимизацию сайта под искусственный интеллект

Для искусственного интеллекта robots.txt, карта сайта, скорость страниц, чистота кода, отсутствие дублей, адаптивность под мобильные устройства, высокий уровень защиты так же важны, как и для поисковых систем. С развитием ИИ еще более важной стала разметка, ведь ее отсутствие или неправильная настройка может стать главной преградой на пути к цитированию ИИ системами. А в 2024 году еще и добавился стандарт llms.txt, который помогает ИИ получить ключевую информацию про интернет-проект.

- Базовая техническая оптимизация под искусственный интеллект

- Особые требования к Robots.txt в 2026 году

- Как создать файл llms.txt для искусственного интеллекта

- Как настроить микроразметку Schema.org для ИИ систем

Базовая техническая оптимизация под искусственный интеллект

Техническая оптимизация под искусственный интеллект почти полностью совпадает с классическим SEO — и это хорошая новость. Если сайт технически здоров с точки зрения Google, он уже наполовину готов к AI-видимости. Разница — в нескольких новых требованиях и смещении приоритетов:

- Core Web Vitals. Время загрузки наиболее видимого элемента LCP должно быть меньше 2.5 секунд. Время ответа страницы на действие пользователя не должно превышать 200 мс. А временное окно для смещения макета во время подгрузки тяжелых элементов может быть максимум 1 секунда. В блоге Cityhost есть полезный материал об основных метриках скорости загрузки сайта, которые важны и для SEO, и для GEO.

- Карта сайта. Основное требование осталось — наличие файла sitemap.xml в корне сайта с регистрацией в Google Search Console и Bing Webmaster Tools. Но Perplexity и некоторые другие ИИ-системы используют sitemap для первичного обхода веб-ресурса перед индексацией, поэтому карта должна мгновенно обновляться при публикации нового контента, не содержать удаленных или редиректных URL. Если сайт на WordPress, рекомендуем использовать Rank Math или Yoast, которые являются лучшими SEO плагинами с всем необходимым функционалом для sitemap.xml.

- Безопасность. Протокол HTTPS остается критическим фактором ранжирования, соответственно, SSL сертификат — это обязательное условие для успешного продвижения в поисковых и ИИ системах.

- Чистота кода. Даже здесь ИИ немного повысил требования, ведь многие боты не способны выполнять скрипты. Лучше отказаться от сложного клиентского JavaScript (CSR) в пользу серверного рендеринга (SSR).

- Мобильная адаптивность. Уже давно важно адаптировать сайт для мобильных устройств, но речь идет не только об использовании правильных шаблонов или верстки. Проверяйте каждую страницу на разных устройствах, ведь часто веб-ресурс адаптирован профессионально, а конкретная страница отображается некорректно на смартфоне или планшете из-за специфических блоков или интерактивных элементов.

- Битые ссылки. Постоянно проверяйте сайт через Screaming Frog (бесплатно до 500 URL) или Ahrefs Webmaster Tools на отсутствие внутренних ссылок, ведущих на несуществующие страницы. В 2026 году основными типами дублей являются канонические и параметрические, а также дубли категорий и тегов, которые часто встречаются на WordPress.

- Редиректы. Их использование является нормальной практикой, но при отсутствии цепочек, когда URL ведет через 2-3 промежуточные адреса к финальной. Всегда должно быть лишь одно редирект, то есть старый адрес сразу ведет пользователя на новый.

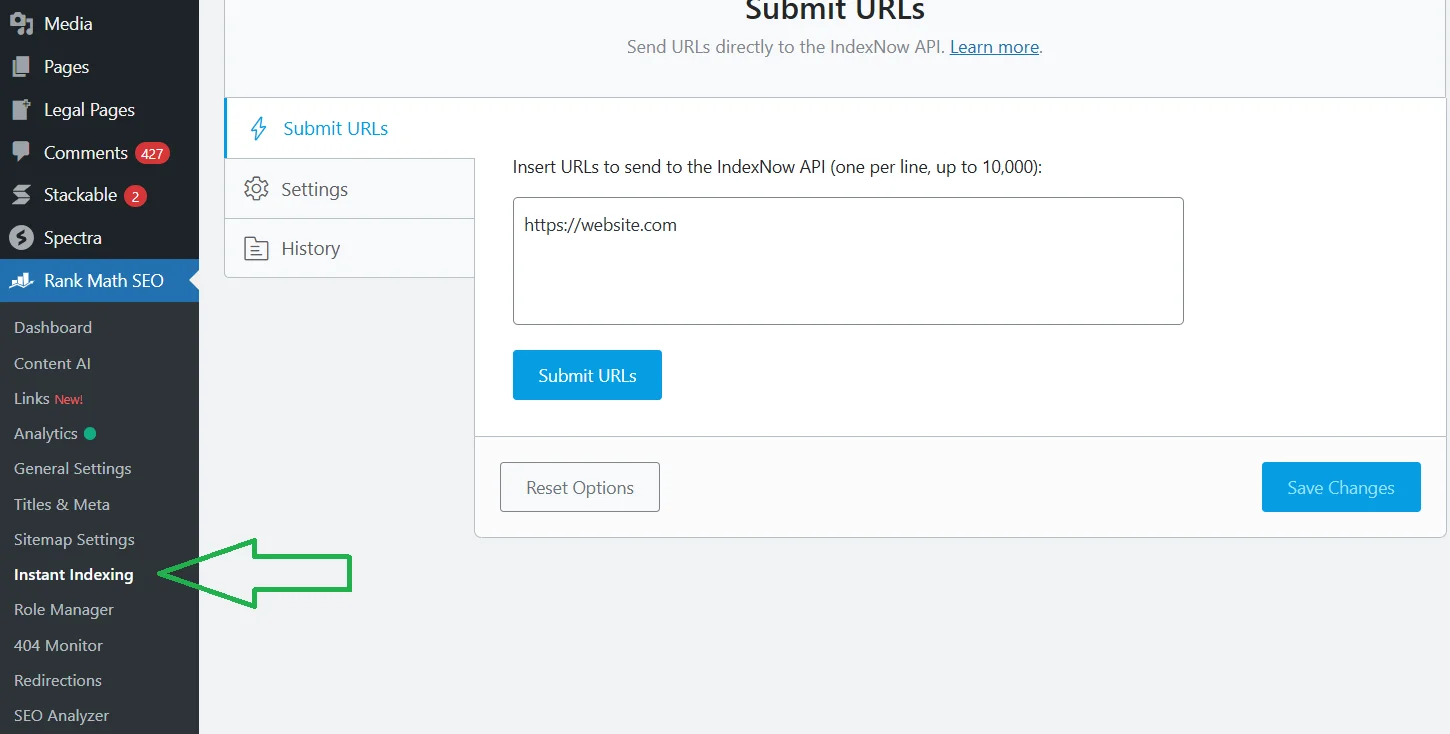

Отдельно хочу выделить IndexNow — стандарт для мгновенного уведомления как поисковых, так и ИИ систем об обновлении контента. Для владельцев сайтов на WordPress есть комплексные SEO плагины с поддержкой этого протокола. Например, я использую бесплатную версию Rank Math, которая поддерживает мгновенную индексацию как каждой страницы отдельно, так и большого количества сразу (до 10 000).

В разделе Rank Math → Instant Indexing сначала указываете список URL (каждый с новой строки), затем подаете их на индексацию и сохраняете изменения.

Особые требования к Robots.txt в 2026 году

Создать файл robots.txt можно за несколько минут с помощью онлайн-сервисов и WordPress плагинов наподобие Rank Math, Yoast, All-in-One. Но для оптимизации сайта под искусственный интеллект классического наполнения недостаточно. Нужно уметь четко различать ботов для обучения и ботов для живого поиска, чтобы случайно не заблокировать доступ к контенту полезным ИИ системам.

Вам нужно проверить, разрешены ли следующие ИИ боты в robots.txt:

- Google-Extended — Gemini;

- ClaudeBot — Anthropic (Claude);

- PerplexityBot — Perplexity;

- ChatGPT-User и OAI-SearchBot — ChatGPT (именно для пользователей).

Многие сайты блокируют вышеописанных ботов по умолчанию из-за настроек безопасности, например, в Cloudflare. Чтобы открыть им доступ, пропишите в файле robots.txt названия ботов через «Allow: /».

Некоторых ИИ ботов, которые собирают данные для обучения, наоборот, лучше заблокировать:

- GPTBot;

- Google-CloudVertexBot;

- Bytespider;

- CCBot;

- meta-externalagent;

- Amazon-bot (если вы не продаете товары на Amazon и не имеете пользы от Alexa).

Заблокировать им доступ можно тоже в файле robots.txt через «Disallow: /». Только важно понимать, что этот файл является лишь рекомендацией: крупные корпорации обычно придерживаются этих правил, а Bytespider и похожие боты — игнорируют. Однако лучше закрыть им доступ, и дополнительно себя защитить, например, с тем же Cloudflare.

Как создать файл llms.txt для искусственного интеллекта

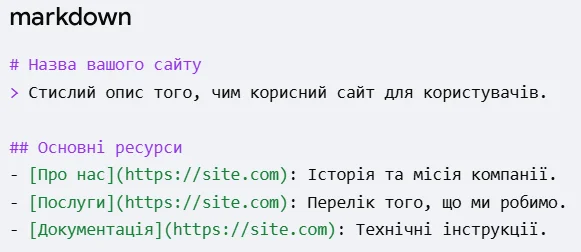

Создать этот файл можно в стандартном текстовом редакторе, например, Notepad или VS Code. Документ нужно называть именно llms.txt, а не LLMS.txt. В нем следует прописать:

- # Название проекта — основной заголовок.

- > Краткое описание — суть сайта.

- ## Разделы.

Потом сохраняете файл и размещаете в корневой папке сайта, где уже находится robots.txt. И сразу можете его проверить по адресу вашсайт.com/llms.txt. Если же проект большой, тогда можно создать llms-full.txt, где разместить гораздо больше ссылок и детальной информации, тогда как основной llms.txt оставить как лаконичное вступление.

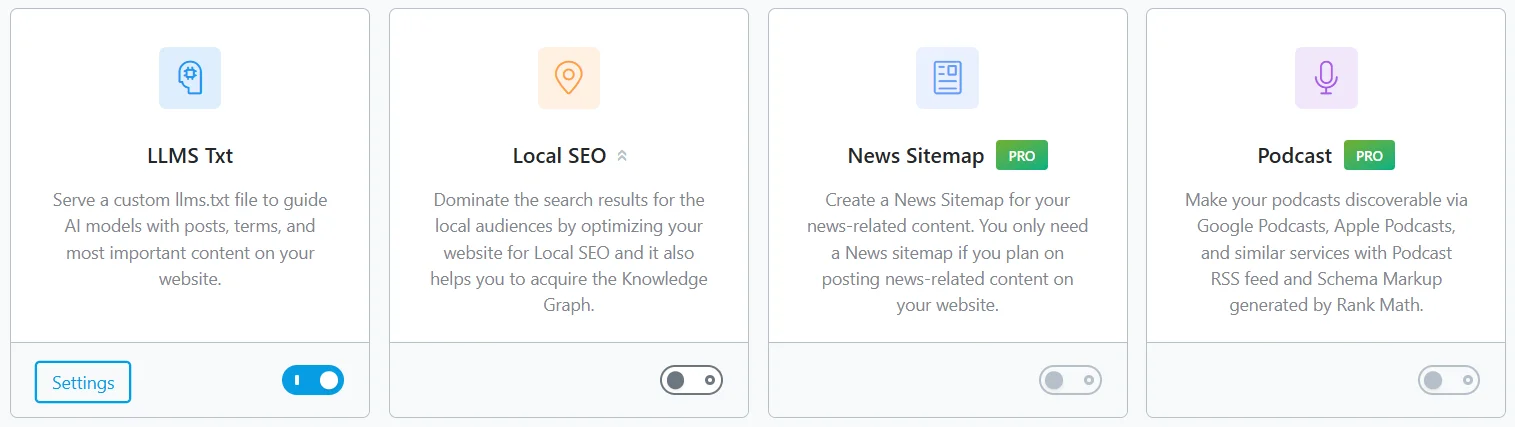

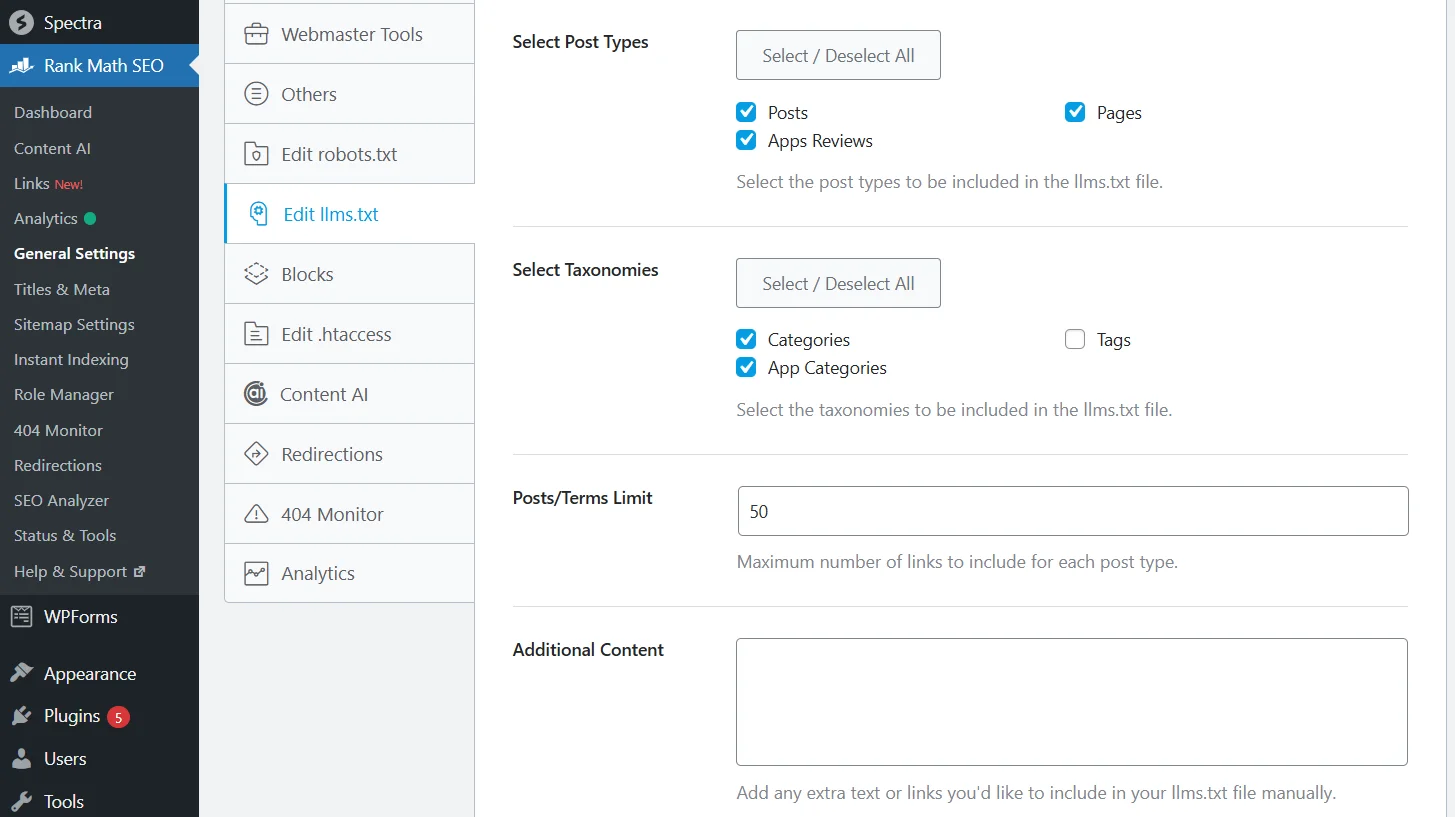

Для WordPress есть множество плагинов для автоматического создания llms.txt, включая LLMs.txt Generator и Website LLMs.txt. Кроме того, классические плагины для поисковой оптимизации сайта тоже поддерживают этот файл. Я использую именно модуль для Rank Math — LLMS Txt.

Модуль доступен в бесплатной версии с мгновенной активацией.

LLMS Txt от Rank Math поддерживает как стандартные, так и кастомные типы записей.

Как настроить микроразметку Schema.org для ИИ систем

В классическом SEO Schema помогала получить расширенные сниппеты в выдаче, чтобы выделиться среди конкурентов. В эпоху искусственного интеллекта микроразметка стала еще важнее, ведь позволяет ИИ однозначно понимать тип контента.

К основным типам Schema относится:

- FAQPage — прямой источник для формирования ответов ИИ, соответственно, лучший способ получать упоминания и ссылки из ответов искусственного интеллекта.

- Organization — устанавливает идентичность бренда, включая логотип, контакты и соцсети компании.

- Article — стандартная микроразметка для записей, которая обязательно должна содержать поля dateModified (ИИ обращает особое внимание на актуальность данных) и author со ссылкой на профиль эксперта.

- Review — полезная разметка, которую я использую для обзоров.

- Product — чрезвычайно важна для e-commerce, ведь позволяет ИИ извлекать данные о цене, наличии и отзывах для сравнения товаров.

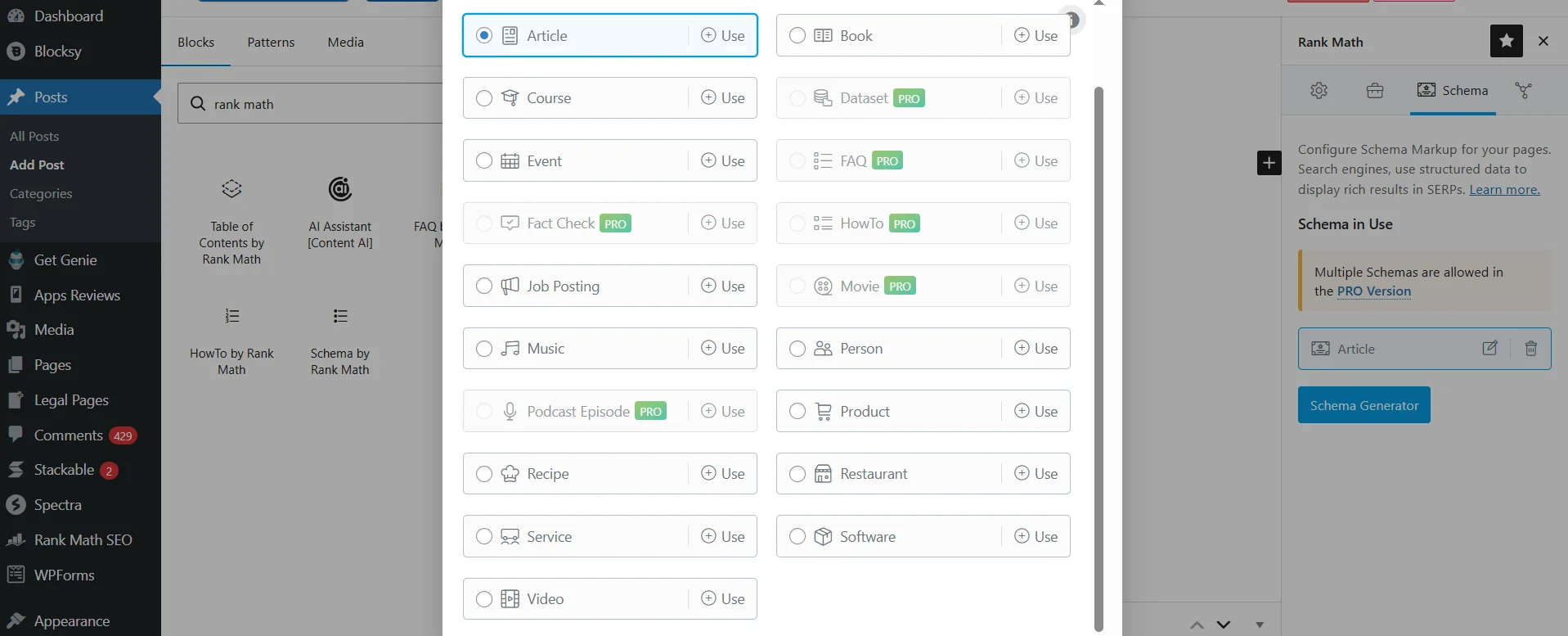

Для генерации микроразметки можно использовать официальный инструмент Schema.org Generator. Если хотите упростить процесс, тогда стоит использовать один из популярных SEO плагинов, например, тот же Rank Math.

Однако здесь уже придется столкнуться с ограничениями бесплатной версии: часть схем доступна лишь в платной версии, плюс чисто технически нельзя добавить 2-3 и более разметок. Но, если вставлять, например, вопросы и ответы через FAQ by Rank Math прямо на страницу, то все настраивается и индексируется. Только не забывайте проверять результаты в Rich Results Test, чтобы убедиться, что данные считываются правильно.

Читайте также: Лучшие ИИ-сервисы для SEO: оптимизация сайта без лишних усилий

Как оптимизировать контент для ИИ систем

Для создания контента, который будут цитировать ИИ системы, нужно переходить от мысли «Какие ключевые слова вводят люди?» к «Какие вопросы задают пользователи — и какой точный ответ они ожидают?». Ваша цель — создать автономный блок текста, который искусственный интеллект сможет извлечь со страницы и вставить в ответ пользователю без исправлений.

Для этого следует использовать современную структуру контента:

- Заголовок H2 в форме распространенного запроса пользователей. Например, «Как рассчитать мощность кондиционера?».

- Прямой ответ сразу под заголовком, без долгих вступлений. Например, «Площадь комнаты нужно разделить на 10. Соответственно, если это комната 20 м², нужен кондиционер на 2 кВт, 40 м² — 4 кВт».

- Глубокая детализация, где вы уже добавляете уникальные данные, собственные кейсы или профессиональные нюансы. Например, «Для лучшей точности не следует игнорировать дополнительные источники тепла. Из собственного опыта могу сказать, что добавление по 0.1 кВт на каждого человека и 0.5 кВт на технику позволяет…».

Кроме структуры блоков, важно, как выглядит сам текст. ИИ системы значительно легче обрабатывают и чаще цитируют материалы, которые содержат абзацы из 3-5 предложений, нумерованные и маркированные списки, таблицы.

Почему личный опыт стал обязательным требованием

В 2023-2025 годах ИИ системы столкнулись с массовым потоком однотипного контента, сгенерированного самим же ИИ. В ответ модели начали предоставлять явное преимущество источникам с сигналами реального человеческого опыта. Именно поэтому, несмотря на важность конкретики, особенно в первом абзаце после подзаголовка, ваш сайт не должен становиться справочником, ведь такие веб-ресурсы просто не выдержат конкуренции с искусственным интеллектом.

Напротив, личный опыт сейчас критически важен как для людей, так и для ИИ. Это подтверждается концепцией E-E-A-T, где первая «E» — Experience (опыт) — появилась в 2022 году именно как ответ Google на рост безличного контента. Искусственный интеллект взял этот же принцип отбора надежных источников для цитирования: материал без автора и без опыта не может считаться надежным источником.

Показать свой опыт и экспертность на сайте можно с помощью:

- Страницы автора. Теперь недостаточно просто поставить имя под статьей. Важно, чтобы автор имел отдельную страницу, где указана его специализация, опыт, образование, примеры реальных проектов или публикаций.

- Подписи автора. Под каждым материалом должен быть блок автора с фотографией, именем, коротким био и ссылкой на эту страницу. И это касается не только блогов или онлайн журналов, а и компаний: выберите нескольких членов команды, создайте им профили и публикуйте от их имени.

- Первого лица. Как я уже говорил, не нужно делать из статьи ваш личный дневник, но там, где это уместно — следует показать опыт. Например, «Я месяц тестировал 5 хостинг-провайдеров и выбрал лучший надежный недорогой хостинг для сайта» или «Этот повербанк у меня падал десятки раз, а снаружи как новый».

- Даты публикации и обновления. ИИ системы, работающие в режиме реального времени, учитывают актуальность источника. Статья, которую обновили 3 месяца назад, получит приоритет над материалом с последним обновлением в 2023 году.

Так что контент, который цитирует ИИ, строится на пересечении трех вещей: четкой структуры для быстрого извлечения ответов, реального опыта как сигнала надежности источника, живого авторского голоса, за которым люди хотят возвращаться на сайт.

Читайте также: Что такое tone of voice — каким тоном бренду говорить со своей аудиторией

Off-Page GEO: от ссылок до репутации

За последние два года произошли важные изменения в подходе к внешней оптимизации со стороны как поисковых систем, так и искусственного интеллекта. Ранее ссылки выполняли одну функцию — передавали «вес» от одного домена к другому, а алгоритм считал количество и качество этих связей. В 2026 году ссылки остаются важными, но для ИИ они скорее являются одним из доказательств надежности источника, чем ключевым критерием для его выбора.

В результате уже известные типы Off-Page SEO стали одинаково важными для искусственного интеллекта:

- Упоминания бренда. Когда авторитетное издание пишет «по данным Cityhost» или «как отмечает контент-маркетолог Cityhost Богдана Гайворонская» — ИИ системы фиксируют это как сигнал узнаваемости и надежности бренда. И одно такое упоминание без ссылки важнее, чем 10 слабых беклинков.

- Цитирования на веб-ресурсах с высоким авторитетом домена. Беклинки из профильных изданий с DA 70+ важны как и раньше, но их ценность существенно возросла. Лучше получить несколько таких ссылок, чем сотни из каталогов.

- Авторитетность автора. В классическом SEO авторитетность домена и автора были фактически одним и тем же. В GEO — это два разных сигнала, и оба важны. Если вашего автора где-то цитируют или он пишет статьи под своим именем для других изданий, то его контент на вашем сайте может иметь отличный буст.

Получать упоминания сайта можно на Reddit и Quora, принимая участие в профильных обсуждениях и отвечая на тематические вопросы. Эффективной площадкой для получения и ссылочной массы, и тематического цитирования является Medium: создаете аккаунт и пишете статьи на схожие с вашим сайтом темы, а внутри вставляете ссылки (лучше не спамьте, одного-двух достаточно) и упоминаете свой интернет-проект или компанию. Хотя украинское сообщество на Medium постоянно увеличивается, но конкуренция все равно низкая, особенно по сравнению с англоязычным сегментом.

Стоит ли вообще оптимизировать сайт под искусственный интеллект

Да, но не делать из этого что-то грандиозное, параллельно панически думая, что «SEO умирает». Оно умирает еще с 2003 года, когда Google ввел Florida Update и с 2011 года с Panda Update — начал борьбу с дублированным и слабым контентом. И за последние годы произошло много изменений и новых обновлений, искусственный интеллект действительно забрал большую часть трафика, но вместе с тем принес более высокое качество.

Согласно данным Superprompt за 2025 год, ИИ поиск конвертирует намного лучше, чем традиционный органический поиск. Например, конверсия из Google в среднем составляет 2.8%, тогда как Perplexity — 12.4%, ChatGPT — 14.2%, а Claude — 16.8%. Пользователь, который пришел к вам через Perplexity или ChatGPT, в пять раз чаще совершит целевое действие, например, купит товар или воспользуется услугой, чем человек из Google.

Однако интересно то, что хорошее классическое SEO по-прежнему является лучшей стратегией попадания в ИИ ответ: согласно данным Ahrefs за 2025 год, 76.1% URL, которые цитируются в Google AI Overviews, также ранжируются в ТОП 10 Google по тому же запросу. То есть сам фундамент в виде поисковой оптимизации сайтов остается, а к нему добавляются специфические требования ИИ систем, о которых мы уже говорили:

- Техническая база почти не изменилась. Индексация, скорость, структура — все еще критически важны.

- Контент стал более структурированным и сложным — от ключевых слов до намерений и вопросов, от анонимного текста до верифицированного авторского опыта.

- Внешнее SEO сместилось с «беклинков как увеличения ссылочной массы» до «обратных ссылок как повышения авторитета сайта».

Ключевые принципы (авторитетность, структура, опыт, техническая доступность) работают на всех платформах одновременно, будь то Google, ChatGPT или Claude. Они все решают одну и ту же задачу: найти надежный источник для ответа на запрос человека. Если вы будете понятным и полезным для своей целевой аудитории, а главное — готовым поделиться собственным опытом, то сможете получать трафик и из поисковиков, и из ИИ систем.