- Wie die Indexierung einer Website funktioniert

- Wie man überprüft, ob eine Seite von Google indexiert wurde

- Wie man die Indexierung mit Ahrefs überprüft

- Wie man die Indexierung einer Website beschleunigt

- Wie man Indexierungsprobleme vermeidet

- Wann man eine Website von der Indexierung ausschließen sollte

- Warum eine Seite nicht indexiert wird

- Wie das Hosting die Indexierung einer Website beeinflusst

Die Indexierung — das ist die Grundlage der Sichtbarkeit einer Website in Google. Ohne sie wird selbst der beste Inhalt nicht in der Suche angezeigt, und Besucher finden die Seiten einfach nicht. Vereinfacht gesagt, ist die Indexierung der Prozess, bei dem Suchmaschinen sich mit Ihrer Website „vertraut machen“, die Seiten lesen und entscheiden, ob sie sie den Nutzern anzeigen.

Alles, was Sie veröffentlichen — Nachrichten, Blogs, Produkte, Dienstleistungsseiten — muss indexiert werden. Erst danach beginnt die Website, organischen Traffic zu erhalten. Daher ist die Überwachung der Indexierung ein Teil der täglichen SEO-Routine, ohne die kein Wachstum möglich ist.

Wie die Indexierung einer Website funktioniert

Die Indexierung — das ist ein komplexer, aber durchaus logischer Prozess, bei dem Suchmaschinen die Seiten eines Webressourcen schrittweise durchgehen, um sie in den Suchergebnissen verfügbar zu machen.

Der Indexierungsprozess besteht aus mehreren Schritten:

- Crawling. Googlebot folgt Links, entdeckt neue Seiten und überprüft die Aktualisierung alter Seiten.

- Rendering. Der Bot liest den Code, den Text, Bilder, Meta-Tags, Überschriften und bestimmt, worum es auf der Seite geht und für welche Anfragen sie nützlich sein könnte.

- Indexierung. Alle Informationen über die Seite gelangen in die große Datenbank von Google, wo sie nach relevanten Anfragen gefunden werden können.

Technische Faktoren beeinflussen die Geschwindigkeit der Indexierung:

- Qualität des Hostings und Stabilität des Servers;

- Ladegeschwindigkeit der Seiten;

- Vorhandensein einer Sitemap (sitemap.xml);

- Interne Verlinkung, die dem Bot logische Wege zwischen den Seiten schafft;

- Einzigartigkeit des Inhalts — duplizierter Text wird langsamer indexiert oder gar nicht hinzugefügt.

Die Algorithmen von Google berücksichtigen auch die Aktualisierungsfrequenz der Website. Wenn die Ressource regelmäßig neue Materialien veröffentlicht, besucht der Bot sie häufiger und überprüft Änderungen fast in Echtzeit. Deshalb gelangen Blogs, Online-Medien oder Online-Shops schneller in die Ausgabe als statische Unternehmenswebsites.

Beispielsweise sieht ein Unternehmen, das einen aktiven Blog führt und wöchentlich mehrere Artikel hinzufügt, seine Veröffentlichungen bereits nach 1–2 Tagen in der Suche. Eine Website, die nur alle paar Monate aktualisiert wird, kann eine Woche oder länger auf die Indexierung warten. Die Regelmäßigkeit des Inhalts signalisiert Google, dass die Website „lebendig“ ist und Aufmerksamkeit verdient.

Wie man überprüft, ob eine Seite von Google indexiert wurde

Viele Website-Besitzer fragen sich, wie sie sicherstellen können, dass der Inhalt tatsächlich in der Suche erscheint.

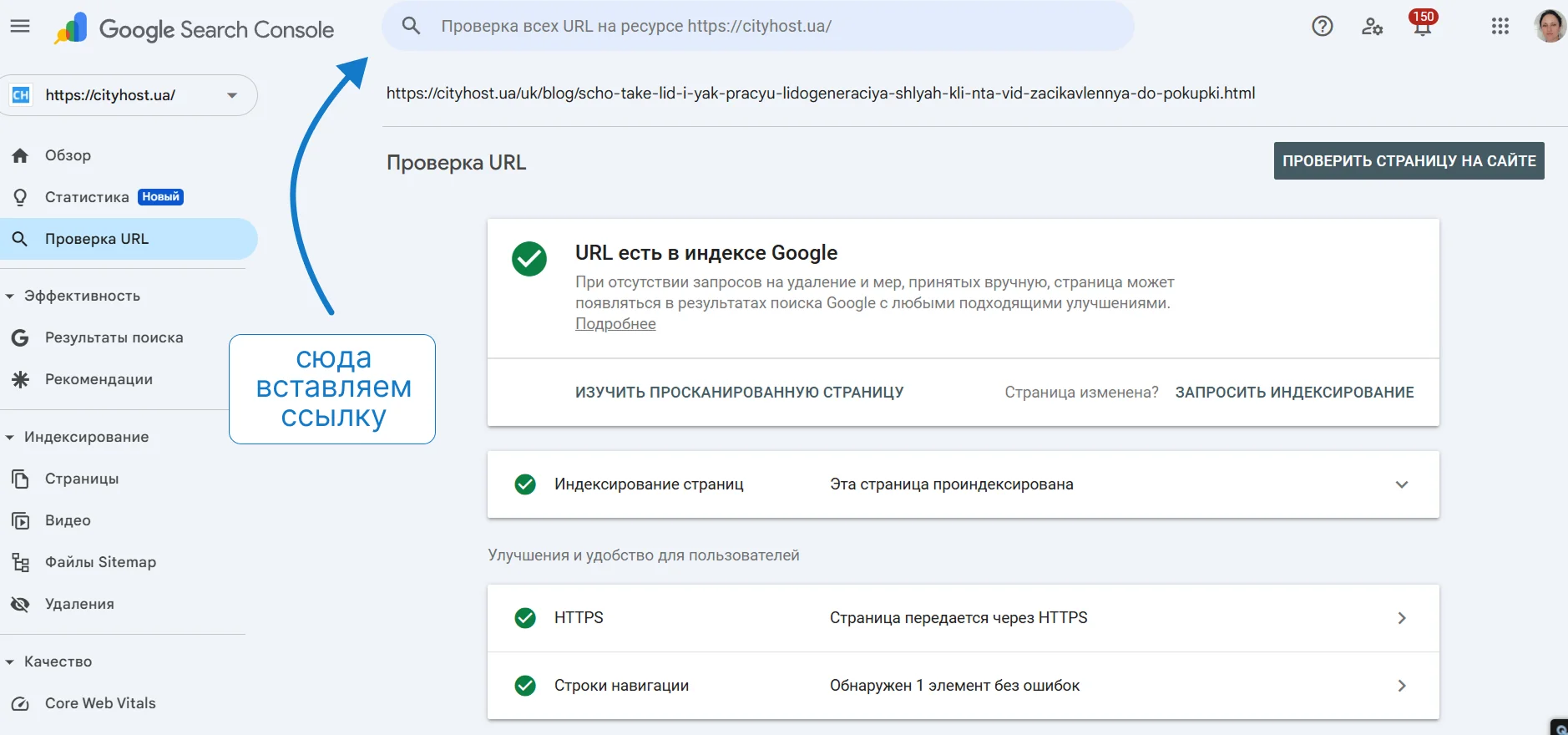

In Google Search Console kann der Indexierungsstatus im Abschnitt „URL-Prüfung“ überprüft werden. Das System zeigt an, wann die Seite zuletzt gecrawlt wurde, ob sie in den Index aufgenommen wurde und ob technische Fehler festgestellt wurden. Für große Websites ist es bequemer, professionelle Dienste wie Ahrefs, Serpstat oder SE Ranking zu verwenden, die eine Massenüberprüfung der Indexierung ermöglichen.

Wie man die Indexierung mit Ahrefs überprüft

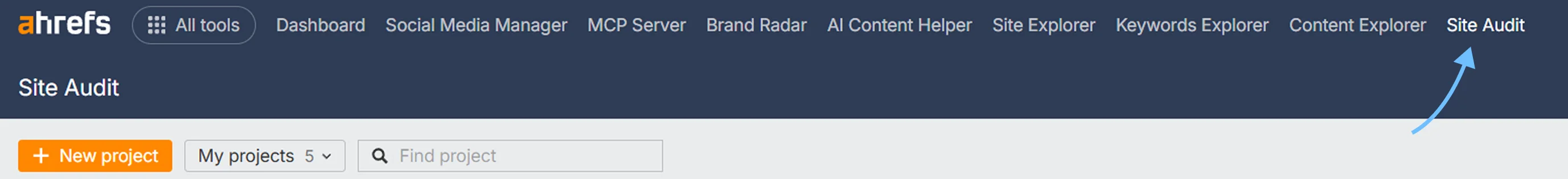

Die technische Indexierung einer Website in Ahrefs kann mit dem Tool Site Audit überprüft werden — es zeigt, welche Seiten für Suchmaschinen zum Crawlen verfügbar sind und welche blockiert sind oder technische Probleme haben. Es ist jedoch wichtig zu verstehen: Ahrefs zeigt nicht, ob die Seiten bereits im Google-Index sind — nur, ob sie indexiert werden können.

In der kostenpflichtigen Version von Ahrefs erhält der Benutzer vollen Zugriff auf Site Audit und kann nicht nur seine eigene Website, sondern auch jede andere Domain überprüfen.

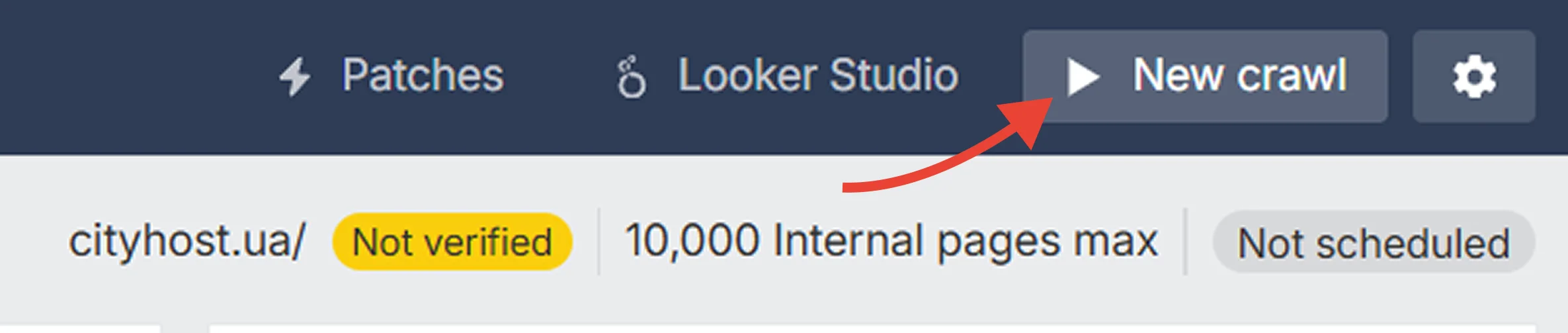

Um mit der Überprüfung zu beginnen, gehen Sie zum Abschnitt Site Audit und fügen Sie die Website über New project hinzu. Sie können eine regelmäßige automatische Überprüfung einrichten oder sie manuell starten. Das System crawlt alle Seiten, erfasst die Serverantwortstatus, noindex-Tags, robots.txt-Direktiven, kanonische Links und erstellt Berichte über die Verfügbarkeit der Seiten zur Indexierung.

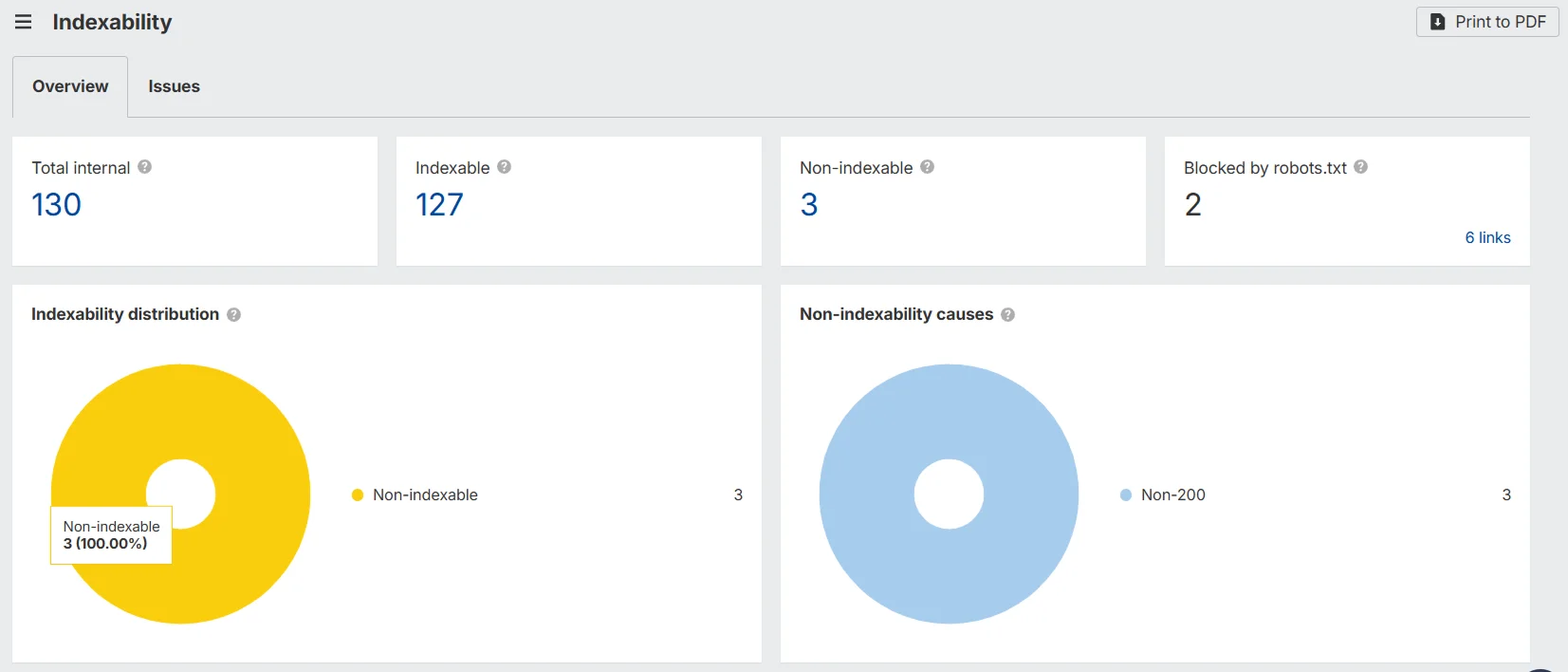

Um die Seiten mit technischen Problemen anzuzeigen, öffnen Sie den Abschnitt Indexability. Dort wird die Anzahl der Seiten angezeigt, die für die Indexierung verfügbar sind, und die Gründe, warum andere nicht indexiert werden können — zum Beispiel das Vorhandensein von noindex-Tags, Blockierungen in robots.txt oder 404-Fehler.

Ahrefs zeigt, dass von 130 geprüften Seiten der Website 127 für die Indexierung verfügbar sind, 3 den Status „Non-200“ (Redirects oder Fehler) haben und 2 in der robots.txt-Datei blockiert sind.

In der kostenlosen Version von Ahrefs Webmaster Tools (AWT) ist die Funktionalität eingeschränkt. Es kann nur die eigene Website (über Bestätigung in Google Search Console) verbunden und ein grundlegendes Audit durchgeführt werden: Überprüfung der Verfügbarkeit von Seiten, Crawling-Status und Vorhandensein von Blockierungen. Aber nochmals, dieses Tool zeigt nicht, ob die Seiten bereits im Google-Index sind.

Um herauszufinden, ob eine Seite tatsächlich indexiert ist, verwenden Sie Google Search Console oder den Befehl site:ihredomain.com in der Suche. Am besten kombiniert man beide Tools: Ahrefs hilft, technische Barrieren zu identifizieren, während die Search Console die tatsächliche Indexierung bestätigt.

In der Praxis wird die Hauptseite der Website fast sofort indexiert, während neue Blogartikel mehrere Tage warten können. Das ist eine normale Situation: Google priorisiert je nach Autorität der Domain, Aktualisierungsfrequenz und Anzahl interner Links.

Lesen Sie auch: Wie man die Hauptseite der Website richtig gestaltet

Wie man die Indexierung einer Website beschleunigt

Die beste Strategie besteht darin, dem Suchmaschinen einen bequemen Weg zu bieten. Google sollte die Seite leicht finden, schnell laden und verstehen, worum es geht. Wenn die Website reibungslos funktioniert und eine klare Struktur hat, erscheinen neue Materialien bereits nach wenigen Stunden in der Suche.

Um die Indexierung zu beschleunigen, sollten Sie umfassend handeln:

- Fügen Sie die Website in Google Search Console hinzu und senden Sie die Sitemap (sitemap.xml), damit der Bot Signale über alle neuen Seiten erhält;

- Verwenden Sie interne Links — sie schaffen für den Bot eine Route zwischen den Seiten und erleichtern das Crawlen;

- Veröffentlichen Sie einzigartigen und nützlichen Inhalt, der sich von der Konkurrenz unterscheidet;

- Verbessern Sie die Ladegeschwindigkeit: optimieren Sie Bilder, reduzieren Sie CSS und JavaScript, aktivieren Sie das Caching;

- Erhalten Sie externe Links — sie helfen den Bots, neue Materialien schneller zu finden;

- Aktualisieren Sie die Website regelmäßig, indem Sie neue Seiten hinzufügen oder alte bearbeiten — das ist ein Signal für Google, dass die Ressource aktiv ist.

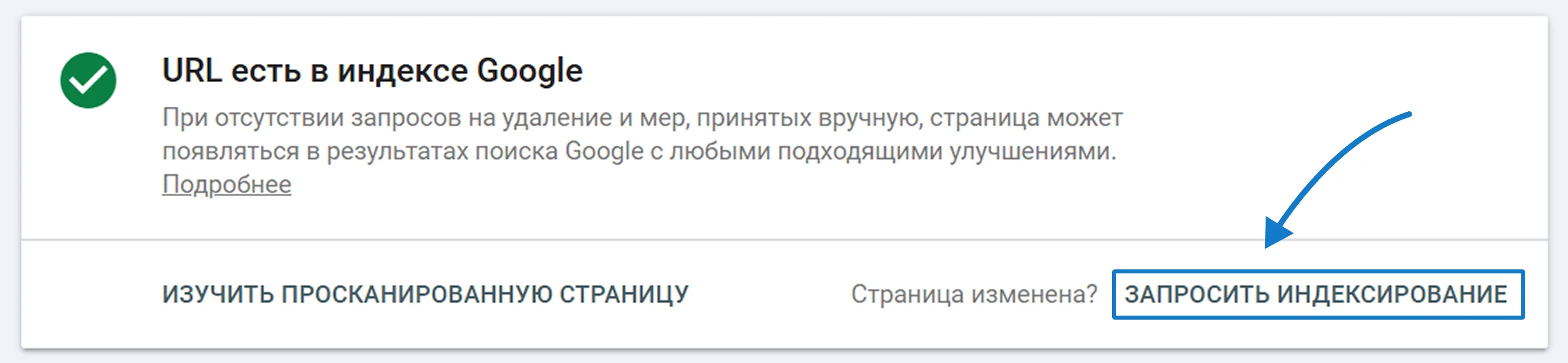

Wenn neues Material nicht indexiert wird oder Sie es bearbeitet haben und die neue Version so schnell wie möglich indexieren möchten, können Sie dies manuell über die Search Console anfordern. Dies ist besonders effektiv für neue Domains oder Seiten ohne externe Links.

Interessante Beobachtung: Externe Links helfen Google, neue Seiten schneller zu entdecken. Der Bot besucht regelmäßig autoritative Ressourcen und folgt den Links, sodass Ihr Inhalt schneller ins Sichtfeld der Suchmaschine gelangt. Das garantiert keine sofortige Indexierung, beschleunigt jedoch erheblich die Phase der Entdeckung von Seiten.

Es sollte auch vermieden werden, dass auf der Seite zu wenig Text vorhanden ist oder wichtige Elemente fehlen — Überschriften, Meta-Beschreibungen, Bilder. Google indexiert besser vollständige Seiten mit logischer Struktur und verständlichem Inhalt. Und das Wichtigste — Stabilität: Regelmäßige Aktualisierungen und technische Sauberkeit ziehen Bots immer schneller an als seltene große Änderungen.

Wie man Indexierungsprobleme vermeidet

Damit Seiten ständig in der Suche erscheinen, muss eine technisch verständliche und logisch aufgebaute Website erstellt werden. Suchroboter sollten den Inhalt leicht finden, crawlen und bewerten können. Häufig entstehen Probleme nicht durch Algorithmen, sondern durch technische Kleinigkeiten — geschlossene Bereiche, duplizierter Text oder fehlende interne Links.

Um diese typischen Fehler zu vermeiden, sollten einige bewährte Regeln beachtet werden:

- Überprüfen Sie robots.txt und Meta-Tags. Stellen Sie sicher, dass wichtige Seiten nicht vom Crawlen ausgeschlossen sind und kein noindex-Attribut enthalten.

- Achten Sie auf die Einzigartigkeit des Inhalts. Google ignoriert duplizierte Materialien, daher sollten die Texte originell und nützlich sein.

- Halten Sie die logische Struktur der Website aufrecht. Interne Links helfen Googlebot, sich zwischen den Seiten zu orientieren und neue Materialien zu finden.

- Aktualisieren Sie die Sitemap (sitemap.xml). Sie signalisiert der Suchmaschine das Vorhandensein neuer Abschnitte oder Artikel.

- Achten Sie auf die Ladegeschwindigkeit. Langsame Seiten verringern die Effizienz des Crawling — Googlebot hat ein begrenztes Zeitbudget für das Crawlen (crawl budget).

Stabile Indexierung — das ist kein Zufall, sondern das Ergebnis systematischer Arbeit. Wenn die Website regelmäßig aktualisiert wird, technisch sauber ist und eine verständliche Navigation hat, werden Suchmaschinen häufiger zurückkehren, was eine schnelle Aufnahme neuer Seiten in den Index gewährleistet.

Wann man eine Website von der Indexierung ausschließen sollte

Manchmal möchte der Besitzer nicht, dass Seiten in der Suche erscheinen, zum Beispiel, wenn es sich um eine Testversion oder einen internen Bereich des Unternehmens handelt.

Die einfachste Option — die robots.txt-Datei, in der das Crawlen bestimmter Verzeichnisse verboten werden kann. Eine andere Möglichkeit — ein noindex-Meta-Tag in den Code der Seite einzufügen:

<meta name="robots" content="noindex, nofollow">

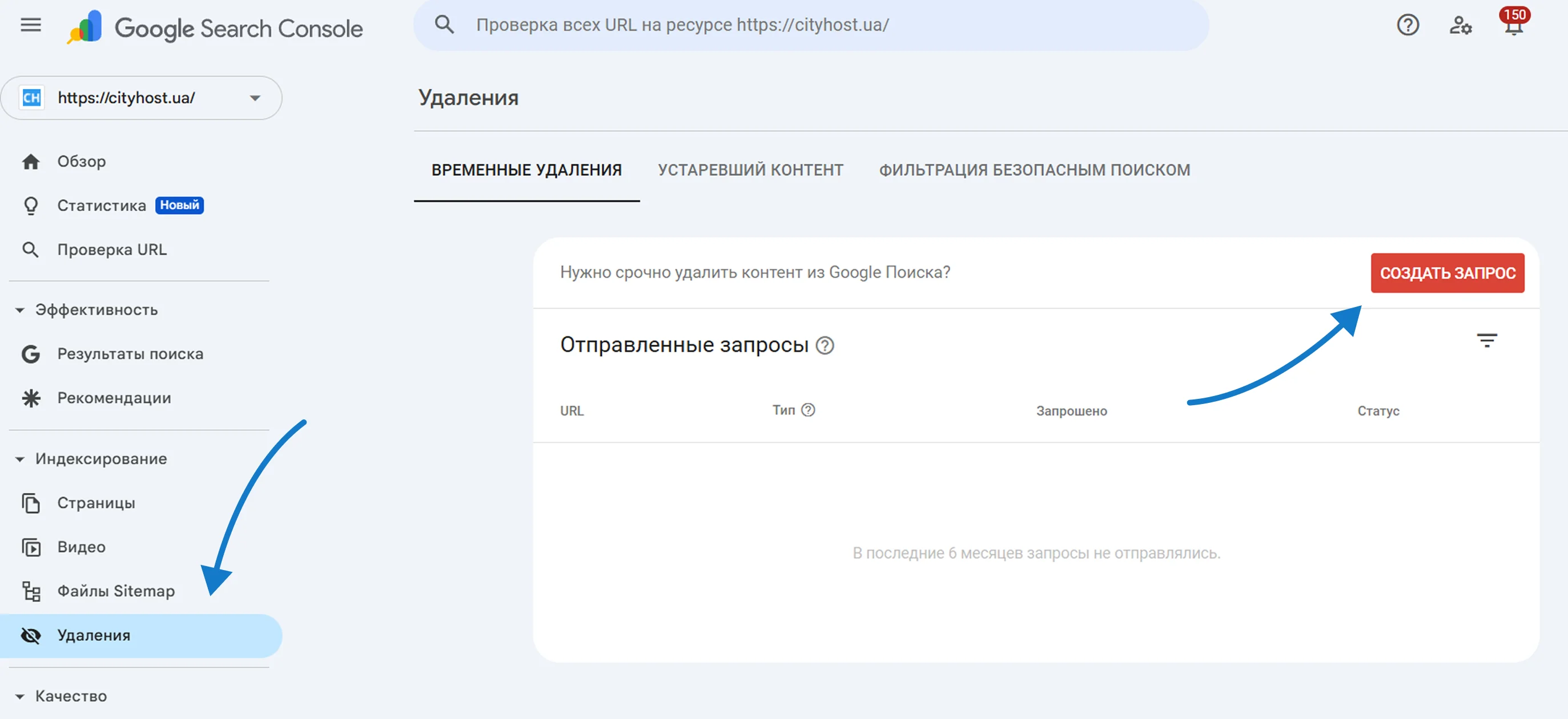

Um eine Seite aus den Suchergebnissen zu entfernen, kann das Tool „Entfernung“ in Google Search Console verwendet werden: Fügen Sie die Adresse über Indexierung → Entfernung hinzu.

Dies entfernt die Seite vorübergehend für 6 Monate aus den Ergebnissen — für eine endgültige Entfernung muss sie mit dem noindex-Tag geschlossen oder von der Website gelöscht werden.

Lesen Sie auch: Wie man eine Website während der Entwicklung von der Indexierung durch Suchmaschinen und von Nutzern verbirgt

Warum eine Seite nicht indexiert wird

Es kommt vor, dass selbst eine qualitativ hochwertige Seite lange nicht in der Suche erscheint. Das ist nicht immer ein Fehler der Entwickler; manchmal sieht Google einfach nicht genügend Wert im Inhalt oder kann ihn nicht richtig verarbeiten.

- Wenn die Seite keinen einzigartigen Inhalt hat oder Teile einer anderen kopiert, kann die Suchmaschine sie ignorieren. Google bevorzugt Seiten, die den Nutzern tatsächlich helfen: sie haben eine verständliche Struktur, laden schnell und enthalten originelles Material.

- Ein weiterer häufiger Grund — die Isolation der Seite. Wenn keine internen Links auf sie verweisen, kann der Bot einfach nicht zu ihr gelangen. Daher ist es wichtig, dass alle neuen Materialien über Menüs, Blöcke „ähnliche Artikel“ oder die Sitemap miteinander verbunden sind.

- Wenn alles richtig gemacht wurde, aber die Indexierung noch aussteht, überprüfen Sie den Status in Google Search Console. Manchmal zeigt das System „Gefunden, aber noch nicht indexiert“ — das bedeutet, dass die Seite bereits gecrawlt wurde, Google sie aber noch nicht in die Datenbank aufgenommen hat. In diesem Fall hilft die Aktualisierung des Inhalts, die Verbesserung der Geschwindigkeit und das Hinzufügen mehrerer interner Links.

Die Hauptregel ist einfach: Eine Seite wird indexiert, wenn sie einzigartig, zugänglich und nützlich ist. Wenn auch nur eine dieser Bedingungen nicht erfüllt ist, sieht die Suchmaschine keinen Sinn darin, sie in die Ergebnisse aufzunehmen.

Wie das Hosting die Indexierung einer Website beeinflusst

Die Geschwindigkeit und Stabilität des Hostings — das ist einer der technischen Faktoren, der direkt die Häufigkeit der Indexierung von Seiten beeinflusst. Wenn der Server langsam auf Anfragen reagiert oder häufig „ausfällt“, kann ein Teil der Seiten außerhalb des Index bleiben.

Suchmaschinen haben ein begrenztes Crawl-Budget — die Anzahl der Seiten, die sie in einem bestimmten Zeitraum durchsuchen können. Wenn die Website langsam lädt oder einen Fehler ausgibt, stoppt der Bot das Crawlen.

Deshalb hilft zuverlässiges, günstiges Hosting mit schnellen SSD-Laufwerken, aktuellen PHP-Versionen, Caching und einem stabilen Netzwerk, die Geschwindigkeit aufrechtzuerhalten, das Crawl-Budget nicht zu verlieren und eine schnellere Indexierung zu fördern.

Die Indexierung — das ist der erste und wichtigste Schritt, damit Ihre Website in Google sichtbar wird. Ohne sie existiert der Inhalt nicht für Suchmaschinen und damit auch nicht für potenzielle Kunden. Überprüfen Sie den Status der Seiten, optimieren Sie die Geschwindigkeit, fügen Sie Sitemaps hinzu und stellen Sie sicher, dass keine technischen Dateien die Arbeit des Bots verbieten. Die Kontrolle der Indexierung ist ein Teil der systematischen SEO-Strategie, die die Sichtbarkeit der Marke in Google direkt bestimmt.