- Was ist der Unterschied zwischen traditionellem SEO und KI-Optimierung

- Wie man die technische Optimierung einer Website für künstliche Intelligenz durchführt

- Wie man Inhalte für KI-Systeme optimiert

- Off-Page GEO: von Links zu Reputation

- Lohnt es sich überhaupt, eine Website für künstliche Intelligenz zu optimieren

Im Jahr 2026 sinkt die Anzahl der Klicks aus den Suchergebnissen auf Webressourcen weiterhin, AI-Überblicksblöcke erscheinen bereits bei 48% der Suchanfragen, und Menschen erhalten sofort Antworten in ChatGPT, Perplexity, Claude. Jetzt muss man nicht nur an SEO, sondern auch an GEO, AEO, AIO und anderen Arten der Optimierung von Internetprojekten arbeiten. Gleichzeitig rentieren sich die Bemühungen, denn der Traffic, der dennoch aus den Links innerhalb der KI-Antworten kommt, konvertiert fünfmal effektiver in Käufe als der gewöhnliche Suchtraffic. Daher kann der richtige Ansatz, nämlich die Fähigkeit, eine Website für die KI-Suche zu optimieren, zu beeindruckenden Ergebnissen führen, an die Sie nicht einmal gedacht haben. Zumal die grundlegenden Prinzipien der Website-Optimierung unverändert geblieben sind; man muss nur lernen, mit den Besonderheiten der KI-Systeme zu arbeiten.

Was ist der Unterschied zwischen traditionellem SEO und KI-Optimierung

Im klassischen SEO muss die Website für das Ranking optimiert werden: Sie streben danach, dass Ihre Seite höher als andere in der Ergebnisliste steht, was die Chancen erhöht, dass der Benutzer genau auf diese klickt. Bei der Optimierung für künstliche Intelligenz liegt der Fokus auf dem Zitiertwerden: Sie streben danach, dass die KI Ihre Informationen, Marke, Sichtweise in ihre Antwort einbezieht.

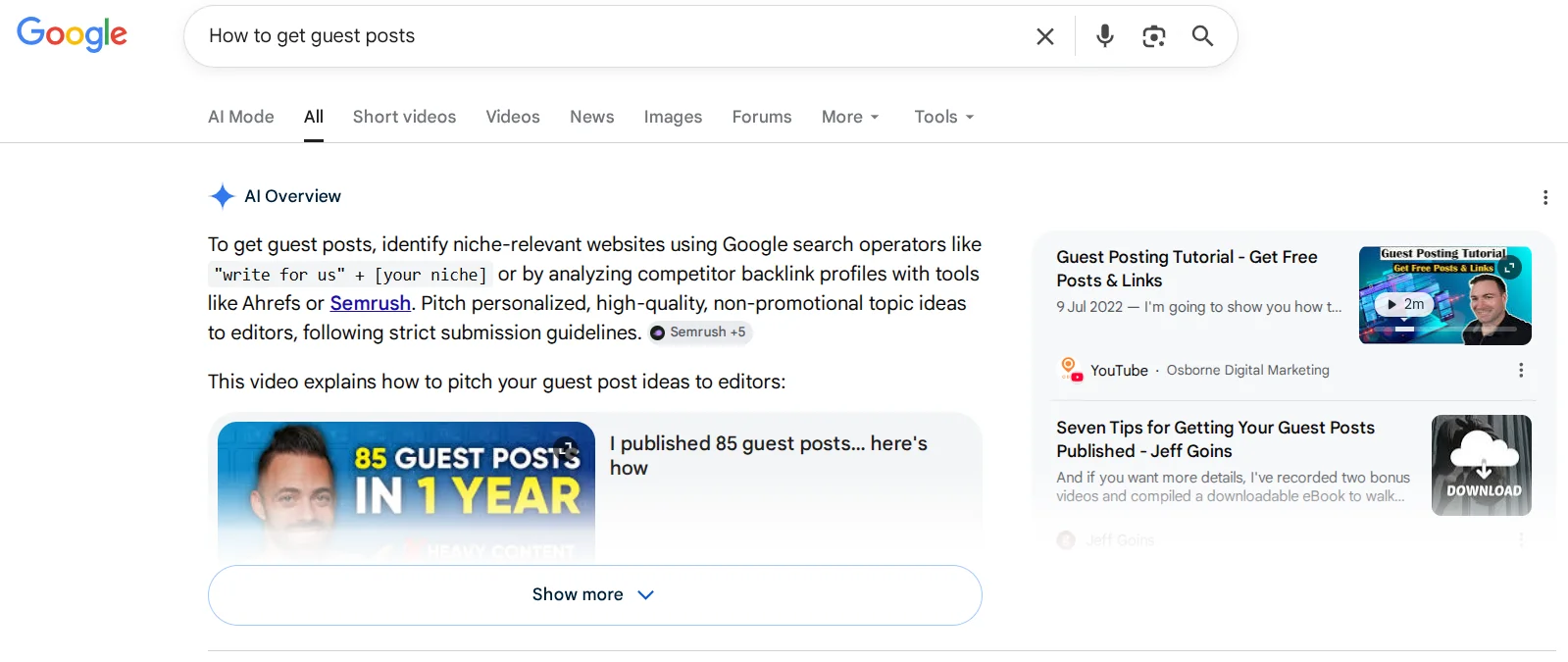

Beispiel für TOP-Quellen von AI-Überblicken

Die unterschiedlichen Ziele ergeben sich aus den grundlegenden Unterschieden in der Funktionsweise von KI-Bots und traditionellen Suchmaschinen-Crawlern wie Googlebot:

- Traditionelle Suchmaschinen erstellen ein Index – eine Bibliothek von Adressen. Wenn ein Benutzer eine Anfrage eingibt, suchen die Bots im Index und geben eine Liste von Adressen aus. Die Liste selbst und die Reihenfolge hängen von der Übereinstimmung des Textes mit der eingegebenen Anfrage und der Autorität der Quelle ab (mit Fokus auf Backlinks). Das bedeutet, dass der Crawler nicht in die Analyse Ihres Textes eintaucht – er klassifiziert ihn.

- Ein Teil der KI-Systeme antwortet ausschließlich aus dem trainierten Modell, ein anderer Teil verwendet RAG (Retrieval-Augmented Generation) für Echtzeitantworten. Im zweiten Fall, wenn der Benutzer eine Anfrage eingibt, führt die KI eine schnelle Suche durch, extrahiert Textfragmente von den vielversprechendsten Websites und gibt sie dem Modell zur Erstellung einer Antwort. Für den Website-Besitzer sind beide Szenarien wichtig: sowohl in die Trainingsdaten zu gelangen als auch eine Quelle für RAG-Extraktion zu sein.

| Merkmal | Traditionelles SEO | Optimierung für KI (GEO/AEO) |

|---|---|---|

| Hauptmechanismus | Indexierung und Ranking von Seiten | Generierung von Antworten basierend auf RAG |

| Art der Anfrage | Set von Schlüsselwörtern (z.B. «Auto kaufen») | Konversationelle Phrase (z.B. «Welches Auto ist besser für eine Familie mit 3 Kindern?») |

| Hauptziel | Hohe Positionen in der Linkliste für Klicks aus den Suchergebnissen zu erhalten | In die KI-Antwort (ChatGPT, Perplexity, Gemini oder AI Overviews) als Quelle oder Zitat gelangen. |

| Schlüsselfaktoren | Schlüsselwörter, Backlinks | Strukturierte Daten (Schema), Autorität (E-E-A-T), Relevanz des Kontexts und Zitation. |

| Inhaltsformat | Artikel, die für spezifische Suchanfragen optimiert sind. | Klare Fakten, direkte Antworten auf Fragen, tiefgehende Expertise und lebendige Fälle. |

Ein wichtiger Punkt ist nicht nur der Unterschied im Prinzip der Funktionsweise der Bots und dem endgültigen Ziel des Website-Besitzers, sondern auch die Orte, an denen die Antworten bereitgestellt werden. Während wir im SEO Seiten optimieren, damit sie in den Suchergebnissen (Google, Bing, Yahoo!) erscheinen, müssen wir bei der Arbeit mit künstlicher Intelligenz sicherstellen, dass die Webressource sowohl in den Suchergebnissen als auch in spezifischen Chatbots zitiert wird. Daher entsteht große Verwirrung in den Begriffen, nämlich GEO, AIO, AEO.

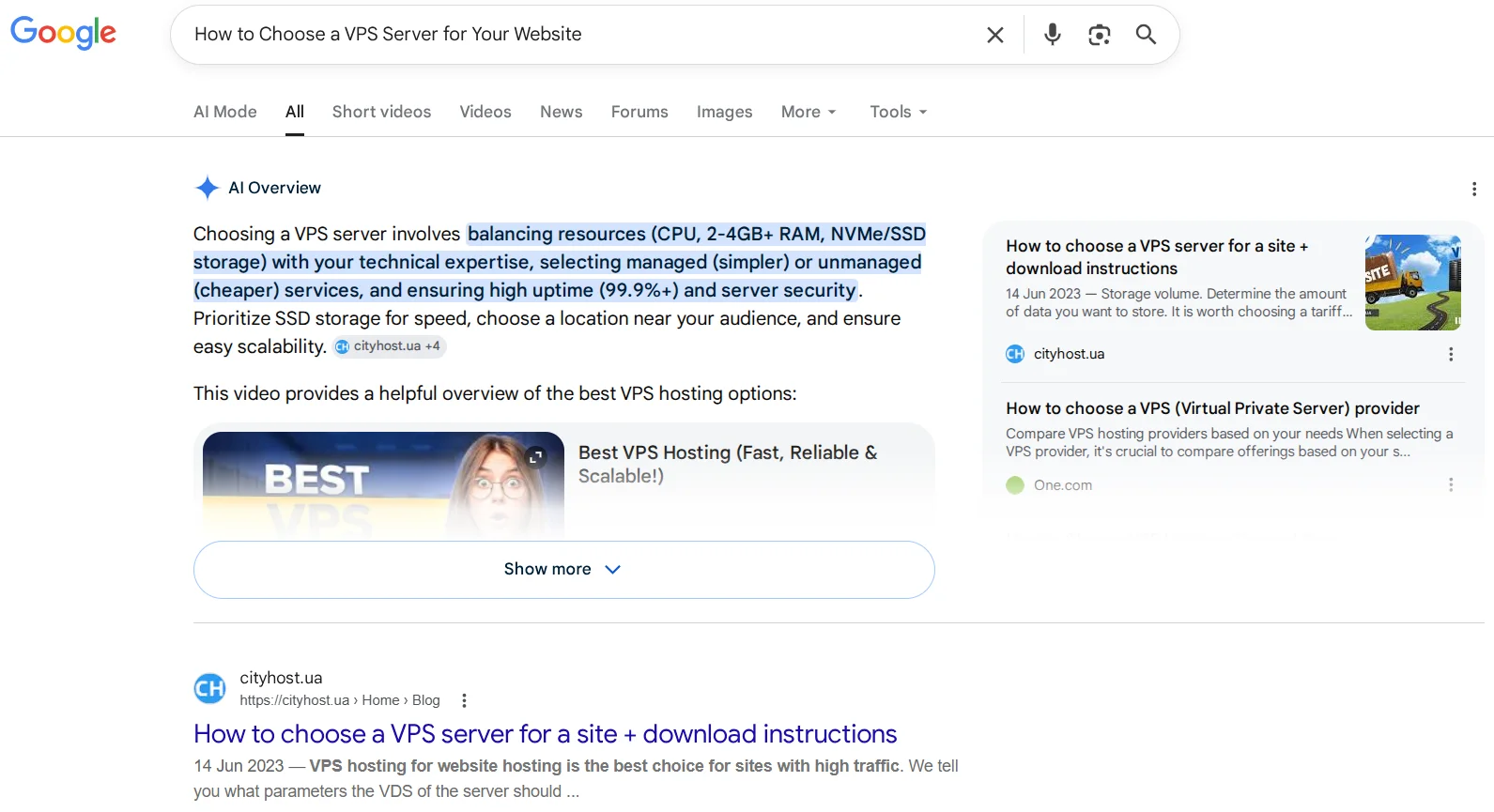

Trotz wichtiger Unterschiede nähern sich SEO und KI allmählich an. Die Anforderungen der Suchbots werden immer ähnlicher den KI-Bots: klare Antworten auf Benutzeranfragen, persönliche Erfahrung, tiefes Verständnis des Themas, strukturierte Daten, Links von autoritativen Quellen und nicht einfach Hunderte von Backlinks aus Verzeichnissen. Zum Beispiel belegt der Artikel von Cityhost über die Auswahl eines VPS-Servers den ersten Platz in den Google-Ergebnissen und den zweiten in AI Overview. Bei seiner Erstellung haben Bohdana Haivoronska und Andrii Zarovynskyi genau die Schlüsselpunkte aus der standardmäßigen Suchmaschinenoptimierung von Websites verwendet, moderne Anforderungen der Suchmaschinen hinzugefügt und diese geschickt mit den Besonderheiten der künstlichen Intelligenz kombiniert.

Lesen Sie auch: Künstliche Intelligenz – Freund, Liebhaber, Psychologe

Wie man die technische Optimierung einer Website für künstliche Intelligenz durchführt

Für künstliche Intelligenz sind robots.txt, die Sitemap, die Seitenladegeschwindigkeit, die Codequalität, das Fehlen von Duplikaten, die Anpassungsfähigkeit an mobile Geräte und ein hohes Sicherheitsniveau ebenso wichtig wie für Suchmaschinen. Mit der Entwicklung von KI ist die Markierung noch wichtiger geworden, da deren Fehlen oder falsche Konfiguration das Haupthindernis für die Zitation durch KI-Systeme darstellen kann. Und im Jahr 2024 kam noch der Standard llms.txt hinzu, der der KI hilft, wichtige Informationen über das Internetprojekt zu erhalten.

- Grundlegende technische Optimierung für künstliche Intelligenz

- Besondere Anforderungen an Robots.txt im Jahr 2026

- Wie man eine llms.txt-Datei für künstliche Intelligenz erstellt

- Wie man die Schema.org-Mikrodaten für KI-Systeme konfiguriert

Grundlegende technische Optimierung für künstliche Intelligenz

Die technische Optimierung für künstliche Intelligenz stimmt fast vollständig mit klassischem SEO überein – und das ist eine gute Nachricht. Wenn die Website aus Sicht von Google technisch gesund ist, ist sie bereits zur Hälfte für die KI-Sichtbarkeit bereit. Der Unterschied liegt in einigen neuen Anforderungen und einer Verschiebung der Prioritäten:

- Core Web Vitals. Die Ladezeit des größten sichtbaren Elements LCP sollte weniger als 2,5 Sekunden betragen. Die Reaktionszeit der Seite auf eine Benutzeraktion sollte 200 ms nicht überschreiten. Und das Zeitfenster für Layoutverschiebungen während des Nachladens schwerer Elemente darf maximal 1 Sekunde betragen. Im Blog von Cityhost gibt es nützliche Materialien zu den wichtigsten Ladegeschwindigkeitsmetriken, die sowohl für SEO als auch für GEO wichtig sind.

- Sitemap. Die Hauptanforderung bleibt – das Vorhandensein einer sitemap.xml-Datei im Stammverzeichnis der Website mit der Registrierung in der Google Search Console und den Bing Webmaster Tools. Aber Perplexity und einige andere KI-Systeme verwenden die Sitemap für das erste Crawlen der Webressource vor der Indexierung, daher muss die Karte sofort aktualisiert werden, wenn neuer Inhalt veröffentlicht wird, und darf keine gelöschten oder umgeleiteten URLs enthalten. Wenn die Website auf WordPress basiert, empfehlen wir die Verwendung von Rank Math oder Yoast, die die besten SEO-Plugins mit allen notwendigen Funktionen für sitemap.xml sind.

- Sicherheit. Das HTTPS-Protokoll bleibt ein kritischer Rankingfaktor, daher ist ein SSL-Zertifikat eine zwingende Voraussetzung für erfolgreiches Marketing in Such- und KI-Systemen.

- Codequalität. Selbst hier hat die KI die Anforderungen etwas erhöht, da viele Bots nicht in der Lage sind, Skripte auszuführen. Es ist besser, auf komplexes clientseitiges JavaScript (CSR) zugunsten des serverseitigen Renderings (SSR) zu verzichten.

- Mobile Anpassungsfähigkeit. Es ist schon lange wichtig, die Website für mobile Geräte anzupassen, aber es geht nicht nur um die Verwendung der richtigen Vorlagen oder Layouts. Überprüfen Sie jede Seite auf verschiedenen Geräten, denn oft ist die Webressource professionell angepasst, während eine bestimmte Seite aufgrund spezifischer Blöcke oder interaktiver Elemente auf Smartphones oder Tablets nicht korrekt angezeigt wird.

- Defekte Links. Überprüfen Sie die Website regelmäßig mit Screaming Frog (kostenlos bis zu 500 URLs) oder Ahrefs Webmaster Tools auf das Fehlen interner Links, die auf nicht existierende Seiten führen. Im Jahr 2026 sind die Haupttypen von Duplikaten kanonische und parameterbasierte sowie Duplikate von Kategorien und Tags, die häufig auf WordPress vorkommen.

- Redirects. Ihre Verwendung ist eine normale Praxis, aber ohne Ketten, wenn eine URL über 2-3 Zwischenadressen zur endgültigen führt. Es sollte immer nur einen Redirect geben, d.h. die alte Adresse führt den Benutzer sofort zur neuen.

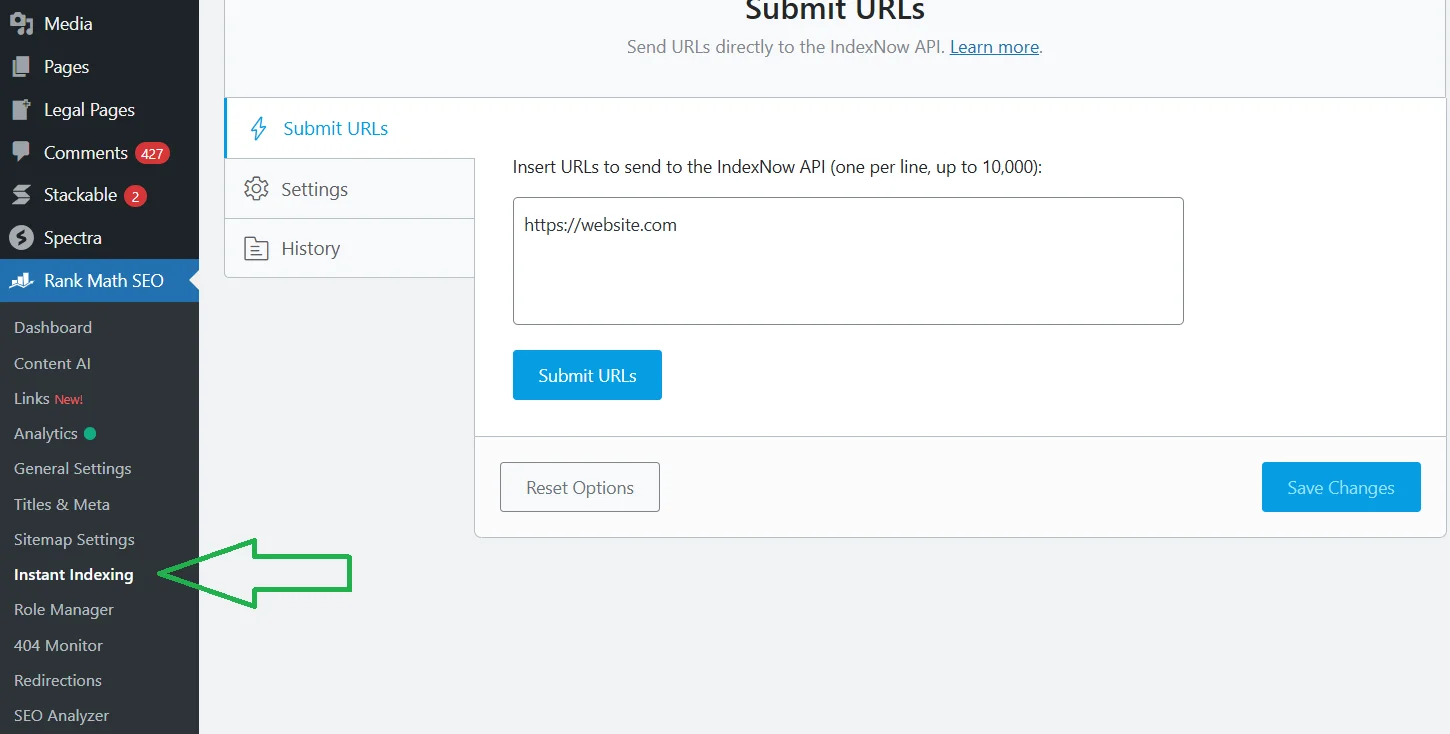

Besonders hervorheben möchte ich IndexNow – einen Standard für die sofortige Benachrichtigung sowohl von Such- als auch von KI-Systemen über Aktualisierungen von Inhalten. Für Website-Besitzer auf WordPress gibt es umfassende SEO-Plugins mit Unterstützung für dieses Protokoll. Zum Beispiel verwende ich die kostenlose Version von Rank Math, die eine sofortige Indizierung sowohl jeder Seite einzeln als auch einer großen Anzahl gleichzeitig (bis zu 10.000) unterstützt.

Im Abschnitt Rank Math → Instant Indexing geben Sie zunächst die Liste der URLs an (jede in einer neuen Zeile), dann reichen Sie sie zur Indizierung ein und speichern die Änderungen.

Besondere Anforderungen an Robots.txt im Jahr 2026

Eine robots.txt-Datei kann in wenigen Minuten mit Online-Diensten und WordPress-Plugins wie Rank Math, Yoast, All-in-One erstellt werden. Aber für die Optimierung der Website für künstliche Intelligenz reicht eine klassische Befüllung nicht aus. Man muss in der Lage sein, Bots für das Training und Bots für die Live-Suche klar zu unterscheiden, um nicht versehentlich den Zugang zu Inhalten für nützliche KI-Systeme zu blockieren.

Sie müssen überprüfen, ob die folgenden KI-Bots in robots.txt erlaubt sind:

- Google-Extended – Gemini;

- ClaudeBot – Anthropic (Claude);

- PerplexityBot – Perplexity;

- ChatGPT-User und OAI-SearchBot – ChatGPT (speziell für Benutzer).

Viele Websites blockieren die oben genannten Bots standardmäßig aufgrund von Sicherheitseinstellungen, z.B. in Cloudflare. Um ihnen den Zugang zu öffnen, fügen Sie in der robots.txt-Datei die Namen der Bots mit «Allow: /» hinzu.

Einige KI-Bots, die Daten für das Training sammeln, sollten hingegen besser blockiert werden:

- GPTBot;

- Google-CloudVertexBot;

- Bytespider;

- CCBot;

- meta-externalagent;

- Amazon-bot (wenn Sie keine Waren auf Amazon verkaufen und keinen Nutzen von Alexa haben).

Um ihnen den Zugang zu blockieren, können Sie dies ebenfalls in der robots.txt-Datei mit «Disallow: /» tun. Es ist nur wichtig zu verstehen, dass diese Datei lediglich eine Empfehlung ist: Große Unternehmen halten sich normalerweise an diese Regeln, während Bytespider und ähnliche Bots sie ignorieren. Es ist jedoch besser, ihnen den Zugang zu verwehren und sich zusätzlich zu schützen, z.B. mit demselben Cloudflare.

Wie man eine llms.txt-Datei für künstliche Intelligenz erstellt

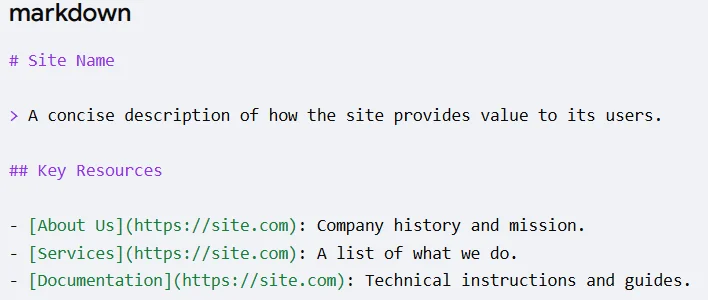

Diese Datei kann in einem Standard-Texteditor, z.B. Notepad oder VS Code, erstellt werden. Das Dokument sollte genau llms.txt genannt werden, nicht LLMS.txt. Darin sollten Sie Folgendes angeben:

- # Projektname – Hauptüberschrift.

- > Kurze Beschreibung – der Kern der Website.

- ## Abschnitte.

Speichern Sie die Datei anschließend und platzieren Sie sie im Stammverzeichnis der Website, wo sich bereits die robots.txt befindet. Und Sie können sie sofort unter der Adresse ihrewebsite.com/llms.txt überprüfen. Wenn das Projekt groß ist, können Sie auch eine llms-full.txt erstellen, in der Sie viel mehr Links und detaillierte Informationen unterbringen, während die Haupt-llms.txt als prägnante Einführung bleibt.

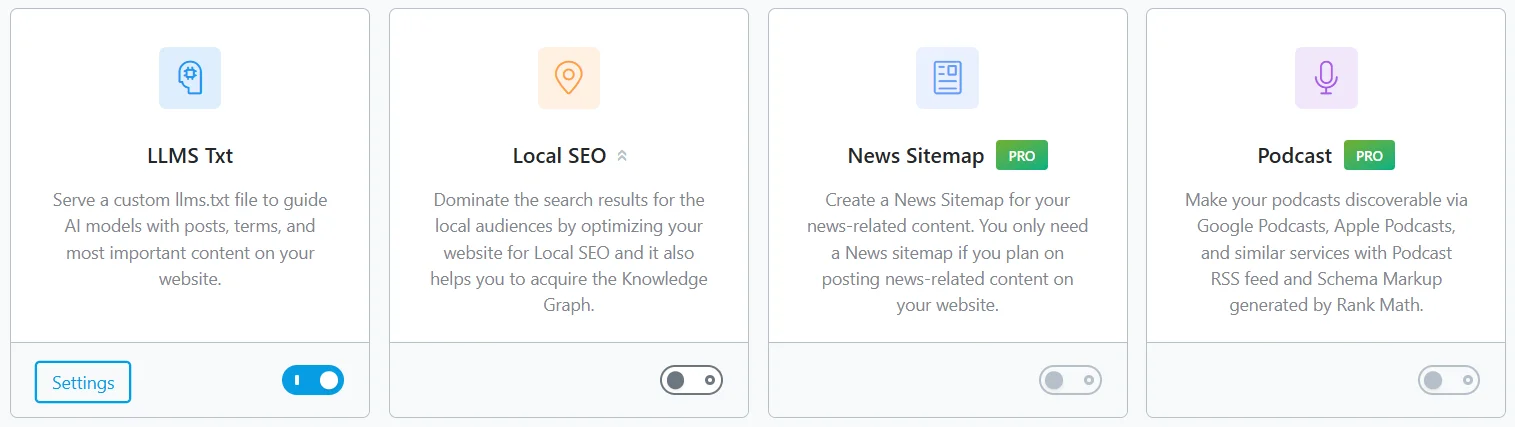

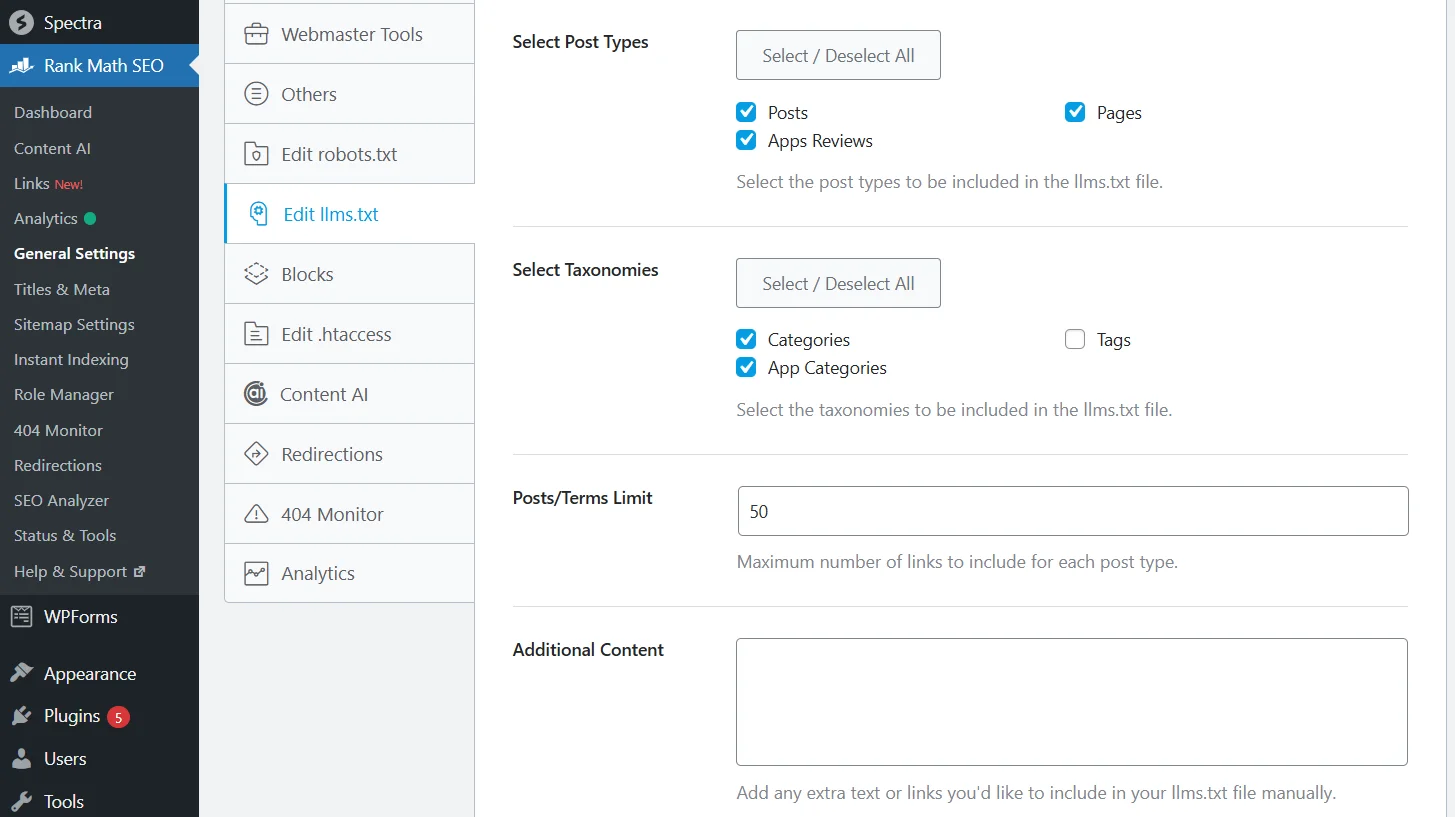

Für WordPress gibt es viele Plugins zur automatischen Erstellung von llms.txt, einschließlich LLMs.txt Generator und Website LLMs.txt. Darüber hinaus unterstützen auch klassische Plugins zur Suchmaschinenoptimierung dieser Datei. Ich verwende das Modul für Rank Math – LLMS Txt.

Das Modul ist in der kostenlosen Version mit sofortiger Aktivierung verfügbar.

LLMS Txt von Rank Math unterstützt sowohl Standard- als auch benutzerdefinierte Beitragstypen.

Wie man die Schema.org-Mikrodaten für KI-Systeme konfiguriert

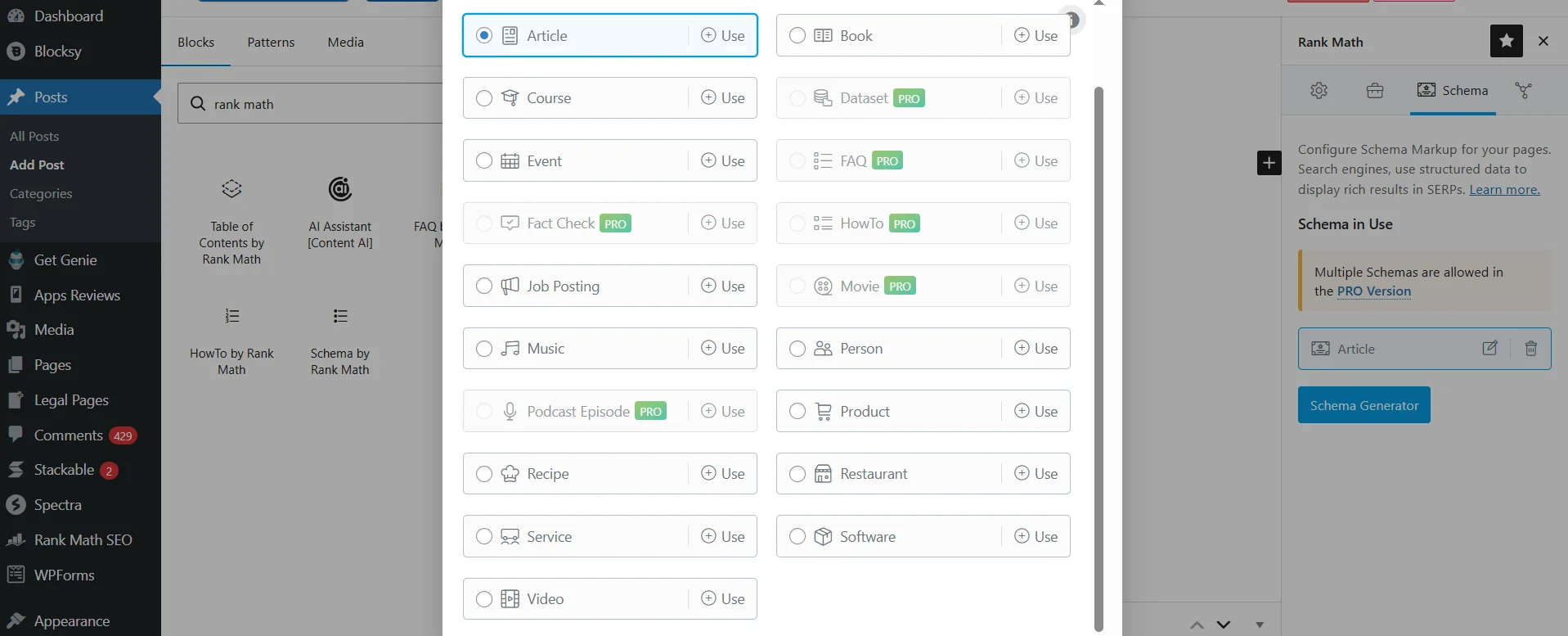

Im klassischen SEO half Schema, erweiterte Snippets in den Ergebnissen zu erhalten, um sich von den Mitbewerbern abzuheben. In der Ära der künstlichen Intelligenz ist die Mikrodatenmarkierung noch wichtiger geworden, da sie es der KI ermöglicht, den Inhaltstyp eindeutig zu verstehen.

Zu den Haupttypen von Schema gehören:

- FAQPage – direkte Quelle für die Bildung von KI-Antworten, entsprechend die beste Möglichkeit, Erwähnungen und Links aus den Antworten der künstlichen Intelligenz zu erhalten.

- Organization – legt die Identität der Marke fest, einschließlich Logo, Kontakte und soziale Netzwerke des Unternehmens.

- Article – standardisierte Mikrodaten für Beiträge, die unbedingt die Felder dateModified (die KI achtet besonders auf die Aktualität der Daten) und author mit einem Link zum Expertenprofil enthalten müssen.

- Review – nützliche Markierung, die ich für Bewertungen verwende.

- Product – extrem wichtig für E-Commerce, da sie der KI ermöglicht, Daten zu Preis, Verfügbarkeit und Bewertungen zum Vergleich von Produkten zu extrahieren.

Zur Generierung von Mikrodaten können Sie das offizielle Schema.org Generator-Tool verwenden. Wenn Sie den Prozess vereinfachen möchten, sollten Sie eines der beliebten SEO-Plugins verwenden, z.B. dasselbe Rank Math.

Allerdings müssen Sie hier bereits mit den Einschränkungen der kostenlosen Version umgehen: Einige Schemata sind nur in der kostenpflichtigen Version verfügbar, und rein technisch ist es nicht möglich, 2-3 oder mehr Markierungen hinzuzufügen. Aber wenn Sie beispielsweise Fragen und Antworten über FAQ by Rank Math direkt auf die Seite einfügen, wird alles konfiguriert und indiziert. Vergessen Sie nur nicht, die Ergebnisse im Rich Results Test zu überprüfen, um sicherzustellen, dass die Daten korrekt gelesen werden.

Lesen Sie auch: Die besten KI-Dienste für SEO: Website-Optimierung ohne unnötige Mühe

Wie man Inhalte für KI-Systeme optimiert

Um Inhalte zu erstellen, die von KI-Systemen zitiert werden, müssen Sie von der Denkweise «Welche Schlüsselwörter geben die Leute ein?» zu «Welche Fragen stellen die Benutzer – und welche genaue Antwort erwarten sie?» übergehen. Ihr Ziel ist es, einen autonomen Textblock zu erstellen, den die künstliche Intelligenz von der Seite extrahieren und in die Antwort des Benutzers ohne Korrekturen einfügen kann.

Hierfür sollten Sie eine moderne Struktur für den Inhalt verwenden:

- H2-Überschrift in Form einer häufigen Benutzeranfrage. Zum Beispiel: «Wie berechnet man die Leistung einer Klimaanlage?».

- Direkte Antwort sofort unter der Überschrift, ohne lange Einleitungen. Zum Beispiel: «Die Fläche des Raumes muss durch 10 geteilt werden. Dementsprechend, wenn es sich um einen Raum von 20 m² handelt, benötigt man eine Klimaanlage mit 2 kW, 40 m² – 4 kW».

- Tiefe Detailierung, in der Sie bereits einzigartige Daten, eigene Fälle oder berufliche Nuancen hinzufügen. Zum Beispiel: «Für eine bessere Genauigkeit sollten zusätzliche Wärmequellen nicht ignoriert werden. Aus eigener Erfahrung kann ich sagen, dass das Hinzufügen von 0,1 kW für jede Person und 0,5 kW für Technik hilft…».

Neben der Struktur der Blöcke ist es wichtig, wie der Text selbst aussieht. KI-Systeme verarbeiten und zitieren Materialien, die Absätze mit 3-5 Sätzen, nummerierte und Aufzählungslisten, Tabellen enthalten, viel einfacher und häufiger.

Warum persönliche Erfahrung zu einer zwingenden Anforderung geworden ist

In den Jahren 2023-2025 sahen sich KI-Systeme mit einem massiven Strom von einheitlichem Inhalt konfrontiert, der von der KI selbst generiert wurde. Als Reaktion begannen die Modelle, Quellen mit Signalen realer menschlicher Erfahrung eindeutig zu bevorzugen. Deshalb, trotz der Bedeutung von Konkretheit, insbesondere im ersten Absatz nach der Überschrift, sollte Ihre Website kein Nachschlagewerk werden, da solche Webressourcen einfach nicht mit künstlicher Intelligenz konkurrieren können.

Im Gegenteil, persönliche Erfahrung ist jetzt sowohl für Menschen als auch für KI von entscheidender Bedeutung. Dies wird durch das Konzept von E-E-A-T bestätigt, bei dem das erste «E» – Experience (Erfahrung) – 2022 als Antwort von Google auf den Anstieg von unpersönlichem Inhalt eingeführt wurde. Künstliche Intelligenz übernahm dasselbe Prinzip der Auswahl zuverlässiger Quellen für Zitationen: Material ohne Autor und ohne Erfahrung kann nicht als zuverlässige Quelle angesehen werden.

Sie können Ihre Erfahrung und Expertise auf der Website zeigen durch:

- Autoren-Seiten. Es reicht jetzt nicht aus, einfach nur einen Namen unter den Artikel zu setzen. Es ist wichtig, dass der Autor eine eigene Seite hat, auf der seine Spezialisierung, Erfahrung, Ausbildung, Beispiele für reale Projekte oder Veröffentlichungen angegeben sind.

- Autorenunterschrift. Unter jedem Material sollte ein Autorenblock mit Foto, Namen, kurzem Bio und Link zu dieser Seite sein. Und das gilt nicht nur für Blogs oder Online-Magazine, sondern auch für Unternehmen: Wählen Sie einige Teammitglieder aus, erstellen Sie Profile für sie und veröffentlichen Sie im Namen dieser.

- Erste Person. Wie ich bereits sagte, sollten Sie aus dem Artikel kein persönliches Tagebuch machen, aber wo es angebracht ist, sollten Sie Erfahrung zeigen. Zum Beispiel: «Ich habe einen Monat lang 5 Hosting-Anbieter getestet und den besten zuverlässigen günstigen Hosting für die Website ausgewählt» oder «Dieser Powerbank ist mir dutzende Male heruntergefallen und sieht von außen wie neu aus».

- Veröffentlichungs- und Aktualisierungsdaten. KI-Systeme, die in Echtzeit arbeiten, berücksichtigen die Aktualität der Quelle. Ein Artikel, der vor 3 Monaten aktualisiert wurde, erhält Priorität gegenüber Material mit der letzten Aktualisierung im Jahr 2023.

Insofern wird der Inhalt, den die KI zitiert, an der Schnittstelle von drei Dingen aufgebaut: einer klaren Struktur für die schnelle Extraktion von Antworten, realer Erfahrung als Signal für die Zuverlässigkeit der Quelle, einer lebendigen Autorenstimme, zu der die Menschen zurückkehren möchten.

Lesen Sie auch: Was ist der Tonfall – wie sollte die Marke mit ihrem Publikum sprechen

Off-Page GEO: von Links zu Reputation

In den letzten zwei Jahren gab es wichtige Veränderungen im Ansatz zur externen Optimierung sowohl von Suchmaschinen als auch von künstlicher Intelligenz. Früher erfüllten Links eine Funktion – sie übertrugen «Gewicht» von einer Domain zur anderen, und der Algorithmus zählte die Anzahl und Qualität dieser Verbindungen. Im Jahr 2026 bleiben Links wichtig, sind aber für die KI eher ein Beweis für die Zuverlässigkeit der Quelle als ein entscheidendes Kriterium für ihre Auswahl.

Infolgedessen sind die bereits bekannten Arten von Off-Page SEO für künstliche Intelligenz gleich wichtig geworden:

- Marken-Erwähnungen. Wenn eine autoritative Publikation schreibt «laut Cityhost» oder «wie der Content-Marketing-Spezialist von Cityhost Bohdana Haivoronska anmerkt» – registrieren KI-Systeme dies als Signal für die Bekanntheit und Zuverlässigkeit der Marke. Und eine solche Erwähnung ohne Link ist wichtiger als 10 schwache Backlinks.

- Zitationen auf Webressourcen mit hoher Domain-Autorität. Backlinks von Fachpublikationen mit DA 70+ sind nach wie vor wichtig, aber ihr Wert hat erheblich zugenommen. Es ist besser, einige solcher Links zu erhalten als Hunderte aus Verzeichnissen.

- Autorität des Autors. Im klassischen SEO waren die Autorität der Domain und des Autors praktisch dasselbe. In GEO sind dies zwei verschiedene Signale, und beide sind wichtig. Wenn Ihr Autor irgendwo zitiert wird oder Artikel unter seinem Namen für andere Publikationen schreibt, kann sein Inhalt auf Ihrer Website einen großartigen Boost erhalten.

Erwähnungen der Website können auf Reddit und Quora erhalten werden, indem man an thematischen Diskussionen teilnimmt und auf thematische Fragen antwortet. Eine effektive Plattform für den Erhalt sowohl von Linkgewicht als auch von thematischer Zitation ist Medium: Sie erstellen ein Konto und schreiben Artikel zu Themen, die ähnlich wie Ihre Website sind, und fügen innerhalb Links ein (es ist besser, nicht zu spammen, ein oder zwei sind ausreichend) und erwähnen Ihr Internetprojekt oder Unternehmen. Obwohl die ukrainische Gemeinschaft auf Medium ständig wächst, ist die Konkurrenz dennoch gering, insbesondere im Vergleich zum englischsprachigen Segment.

Lohnt es sich überhaupt, eine Website für künstliche Intelligenz zu optimieren

Ja, aber machen Sie daraus nichts Großes, während Sie gleichzeitig in Panik geraten, dass «SEO stirbt». Es stirbt seit 2003, als Google das Florida Update einführte, und seit 2011 mit dem Panda Update – begann den Kampf gegen duplizierten und schwachen Inhalt. Und in den letzten Jahren gab es viele Veränderungen und neue Updates, künstliche Intelligenz hat tatsächlich einen großen Teil des Traffics abgezogen, aber gleichzeitig eine höhere Qualität gebracht.

Laut Daten von Superprompt für 2025 konvertiert die KI-Suche viel besser als die traditionelle organische Suche. Zum Beispiel beträgt die Konversionsrate von Google im Durchschnitt 2,8%, während Perplexity – 12,4%, ChatGPT – 14,2% und Claude – 16,8%. Ein Benutzer, der über Perplexity oder ChatGPT zu Ihnen kommt, wird fünfmal häufiger eine Zielaktion durchführen, z.B. ein Produkt kaufen oder einen Dienst in Anspruch nehmen, als eine Person von Google.

Interessanterweise ist gutes klassisches SEO nach wie vor die beste Strategie, um in die KI-Antwort zu gelangen: Laut Daten von Ahrefs für 2025 rangieren 76,1% der URLs, die in Google AI Overviews zitiert werden, auch in den TOP 10 von Google für dieselbe Anfrage. Das bedeutet, dass das Fundament in Form von Suchmaschinenoptimierung für Websites bleibt, und spezifische Anforderungen der KI-Systeme, über die wir bereits gesprochen haben, kommen hinzu:

- Die technische Basis hat sich kaum verändert. Indexierung, Geschwindigkeit, Struktur – alles bleibt kritisch wichtig.

- Inhalte sind strukturierter und komplexer geworden – von Schlüsselwörtern zu Absichten und Fragen, von anonymem Text zu verifiziertem Autorenerlebnis.

- Externe SEO hat sich von «Backlinks als Erhöhung des Linkgewichts» zu «Backlinks als Erhöhung der Autorität der Website» verschoben.

Die grundlegenden Prinzipien (Autorität, Struktur, Erfahrung, technische Zugänglichkeit) funktionieren auf allen Plattformen gleichzeitig, sei es Google, ChatGPT oder Claude. Sie alle lösen dieselbe Aufgabe: eine zuverlässige Quelle für die Antwort auf die Anfrage des Menschen zu finden. Wenn Sie für Ihr Zielpublikum verständlich und nützlich sind und vor allem bereit sind, Ihre eigene Erfahrung zu teilen, können Sie Traffic sowohl aus Suchmaschinen als auch aus KI-Systemen erhalten.