- Jaka jest różnica między tradycyjnym SEO a optymalizacją pod AI

- Jak przeprowadzić techniczną optymalizację strony internetowej pod sztuczną inteligencję

- Jak optymalizować treści dla systemów AI

- Off-Page GEO: od linków do reputacji

- Czy warto w ogóle optymalizować stronę pod sztuczną inteligencję

W 2026 roku liczba kliknięć z wyników wyszukiwania na zasoby internetowe nadal spada, bloki AI Overviews pojawiają się już w 48% zapytań wyszukiwania, a ludzie natychmiast otrzymują odpowiedzi w ChatGPT, Perplexity, Claude. Teraz trzeba pracować nie tylko nad SEO, ale także nad GEO, AEO, AIO i innymi typami optymalizacji projektów internetowych. Wspólnie z tym wysiłki się opłacają, ponieważ ruch, który nadal pochodzi z linków wewnątrz odpowiedzi AI, konwertuje na zakup pięć razy skuteczniej niż tradycyjny ruch z wyszukiwania. Tak więc odpowiednie podejście, a mianowicie zdolność do optymalizacji strony pod wyszukiwanie AI, może przynieść oszałamiające wyniki, o których nawet nie mogłeś pomyśleć. Tym bardziej, że kluczowe zasady optymalizacji stron pozostały niezmienne, trzeba tylko nauczyć się pracować z cechami systemów AI.

Jaka jest różnica między tradycyjnym SEO a optymalizacją pod AI

W klasycznym SEO trzeba optymalizować stronę pod kątem rankingu: dążysz do tego, aby twoja strona zajmowała wyższe miejsce niż inne na liście wyników, co zwiększa szanse, że użytkownik kliknie właśnie na nią. W optymalizacji pod sztuczną inteligencję uwaga skupia się na cytowaniu: dążysz do tego, aby AI uwzględniło twoje informacje, markę, punkt widzenia w swojej odpowiedzi.

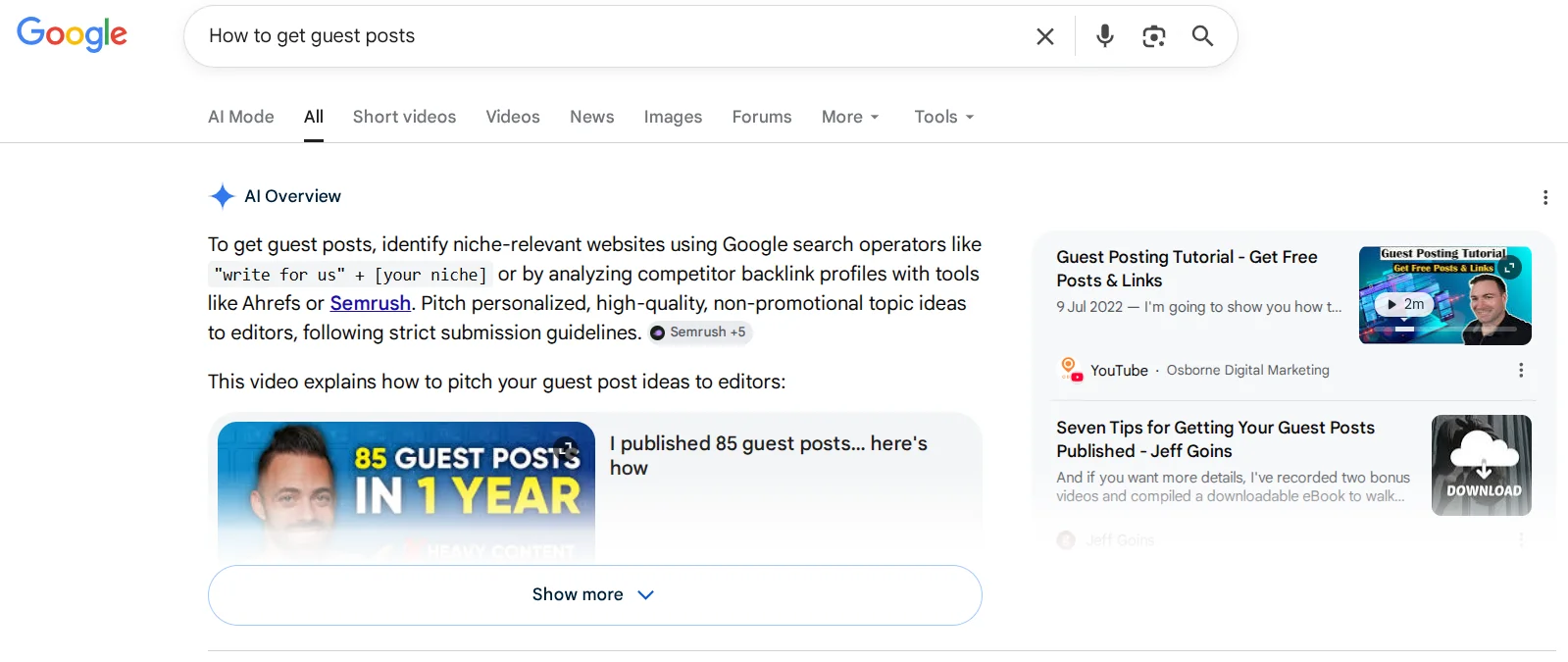

Przykład TOP źródeł od AI Overviews

Różne cele wynikają z fundamentalnych różnic w działaniu botów AI i tradycyjnych crawlerów wyszukiwarek, takich jak Googlebot:

- Tradycyjne systemy wyszukiwania tworzą indeks — bibliotekę adresów. Gdy użytkownik wpisuje zapytanie, boty przeszukują indeks i wydają listę adresów. A sama lista i kolejność w niej zależą od zgodności tekstu z wprowadzonym zapytaniem oraz autorytetu samego źródła (z naciskiem na linki zwrotne). To znaczy, że crawler nie zagłębia się w badanie twojego tekstu — klasyfikuje go.

- Część systemów AI odpowiada wyłącznie na podstawie wyuczonego modelu, część — wykorzystuje RAG (Retrieval-Augmented Generation) do odpowiedzi w czasie rzeczywistym. W drugim przypadku, gdy użytkownik wpisuje zapytanie, AI przeprowadza szybkie wyszukiwanie, wyciąga fragmenty tekstu z najbardziej obiecujących stron i przekazuje je modelowi do napisania odpowiedzi. Dla właściciela strony ważne są oba scenariusze: zarówno dostanie się do danych treningowych, jak i bycie źródłem dla wyciągania RAG.

| Charakterystyka | Tradycyjne SEO | Optymalizacja pod AI (GEO/AEO) |

|---|---|---|

| Główny mechanizm | Indeksacja i ranking stron | Generowanie odpowiedzi na podstawie RAG |

| Typ zapytania | Zestaw słów kluczowych (np. «kupić samochód») | Frazę konwersacyjną (np. «który samochód jest lepszy dla rodziny z 3 dziećmi») |

| Główna meta | Wysokie pozycje na liście linków, aby uzyskać kliknięcia z wyników wyszukiwania | Dostanie się do odpowiedzi AI (ChatGPT, Perplexity, Gemini lub AI Overviews) jako źródło lub cytat. |

| Kluczowe czynniki | Słowa kluczowe, linki zwrotne (backlinks) | Dane strukturalne (Schema), autorytet (E-E-A-T), trafność kontekstu i cytowanie. |

| Format treści | Artykuły, optymalizowane pod konkretne zapytania wyszukiwawcze. | Jasne fakty, bezpośrednie odpowiedzi na pytania, głęboka ekspertyza i żywe przypadki. |

Ważnym momentem jest nie tylko różnica w zasadzie działania botów i ostatecznym celu właściciela strony, ale także w miejscach udzielania odpowiedzi. Jeśli w SEO optymalizujemy strony, aby znalazły się w wynikach wyszukiwania (Google, Bing, Yahoo!), to przy pracy ze sztuczną inteligencją musimy, aby zasób internetowy był cytowany zarówno w wynikach wyszukiwania, jak i w konkretnych chatbotach. Stąd wynika duże zamieszanie w terminologii, a mianowicie — GEO, AIO, AEO.

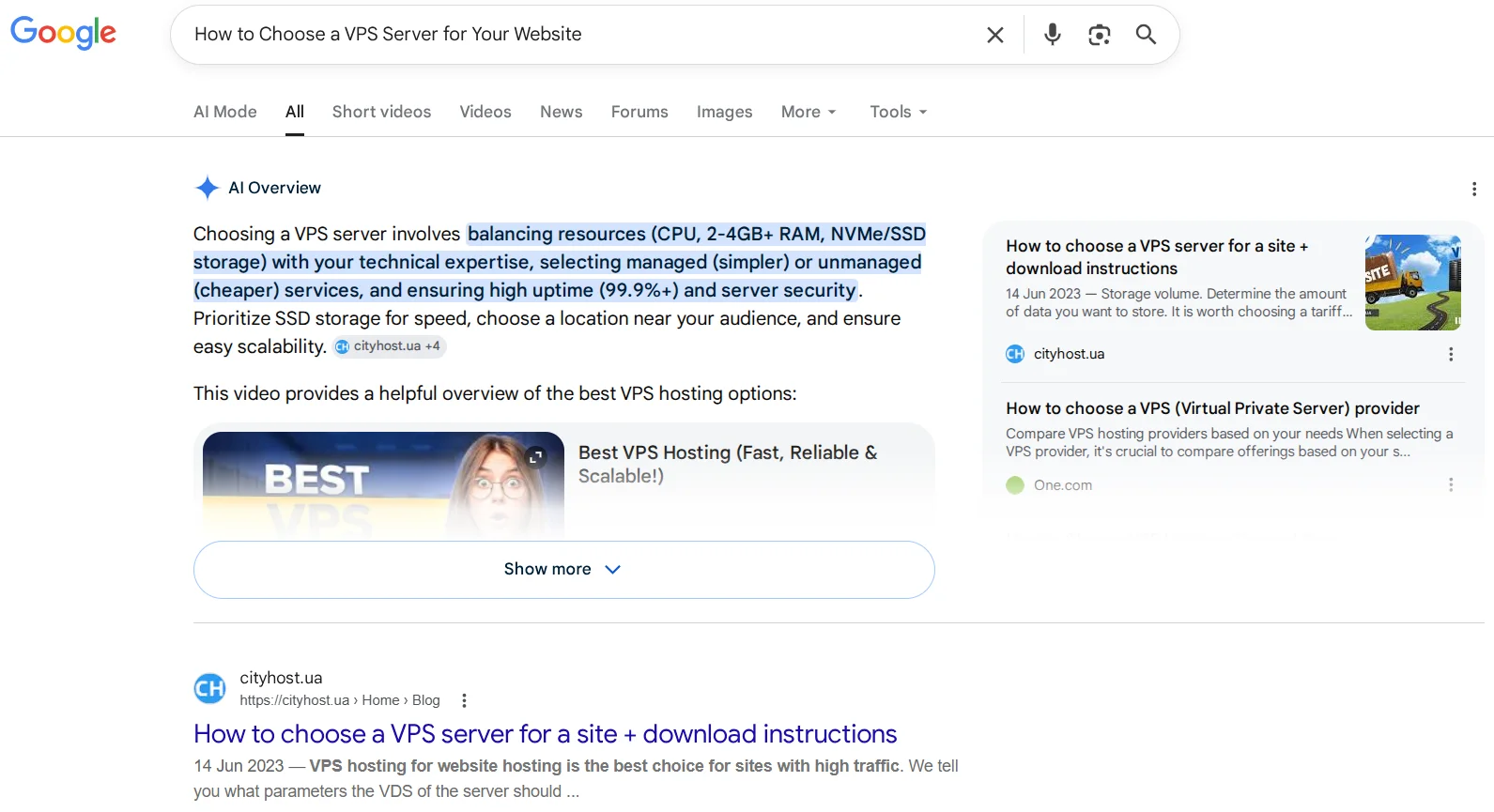

Pomimo ważnych różnic, SEO i AI stopniowo się zbliżają. Wymagania botów wyszukiwania stają się coraz bardziej podobne do botów AI: jasne odpowiedzi na zapytania użytkowników, osobiste doświadczenie, głębokie zrozumienie tematu, dane strukturalne, linki z autorytatywnych źródeł, a nie tylko setki backlinków z katalogów. Na przykład artykuł Cityhost o wyborze serwera VPS zajmuje pierwsze miejsce w wynikach Google i drugie w AI Overview. Przy jego pisaniu Bohdana Hajvoronska i Andrij Zarowynski brali kluczowe punkty ze standardowej optymalizacji wyszukiwania stron, dodawali do nich nowoczesne wymagania wyszukiwarek i umiejętnie łączyli z cechami sztucznej inteligencji.

Przeczytaj także: Sztuczna inteligencja — przyjaciel, kochanek, psycholog

Jak przeprowadzić techniczną optymalizację strony internetowej pod sztuczną inteligencję

Dla sztucznej inteligencji robots.txt, mapa strony, szybkość ładowania, czystość kodu, brak duplikatów, responsywność na urządzenia mobilne, wysoki poziom zabezpieczeń są tak samo ważne jak dla wyszukiwarek. Wraz z rozwojem AI jeszcze bardziej istotna stała się struktura, ponieważ jej brak lub nieprawidłowe ustawienie mogą stać się główną przeszkodą na drodze do cytowania przez systemy AI. A w 2024 roku dodany został standard llms.txt, który pomaga AI uzyskać kluczowe informacje o projekcie internetowym.

- Podstawowa techniczna optymalizacja pod sztuczną inteligencję

- Specjalne wymagania dotyczące Robots.txt w 2026 roku

- Jak stworzyć plik llms.txt dla sztucznej inteligencji

- Jak skonfigurować mikroformat Schema.org dla systemów AI

Podstawowa techniczna optymalizacja pod sztuczną inteligencję

Techniczna optymalizacja pod sztuczną inteligencję niemal całkowicie pokrywa się z klasycznym SEO — i to dobra wiadomość. Jeśli strona jest technicznie zdrowa z punktu widzenia Google, jest już w połowie gotowa na widoczność AI. Różnica — w kilku nowych wymaganiach i przesunięciu priorytetów:

- Core Web Vitals. Czas ładowania największego widocznego elementu LCP powinien być krótszy niż 2,5 sekundy. Czas reakcji strony na działanie użytkownika nie może przekraczać 200 ms. A czasowe okno dla przesunięcia układu podczas ładowania ciężkich elementów może wynosić maksymalnie 1 sekundę. Na blogu Cityhost znajduje się przydatny materiał na temat podstawowych metryk szybkości ładowania strony, które są ważne zarówno dla SEO, jak i dla GEO.

- Mapa strony. Główne wymaganie pozostało — obecność pliku sitemap.xml w głównym katalogu strony z rejestracją w Google Search Console i Bing Webmaster Tools. Ale Perplexity i niektóre inne systemy AI wykorzystują mapę strony do wstępnego przeszukiwania zasobu internetowego przed indeksowaniem, dlatego mapa musi być natychmiast aktualizowana przy publikacji nowej treści, nie może zawierać usuniętych lub przekierowanych adresów URL. Jeśli strona jest na WordPressie, zalecamy korzystanie z Rank Math lub Yoast, które są najlepszymi wtyczkami SEO z całym niezbędnym funkcjonalnością dla sitemap.xml.

- Bezpieczeństwo. Protokół HTTPS pozostaje krytycznym czynnikiem rankingowym, w związku z tym certyfikat SSL — to obowiązkowy warunek dla udanego promowania w systemach wyszukiwania i AI.

- Czystość kodu. Nawet tutaj AI nieco podniósł wymagania, ponieważ wiele botów nie jest w stanie wykonywać skryptów. Lepiej zrezygnować z złożonego klienta JavaScript (CSR) na rzecz renderowania po stronie serwera (SSR).

- Responsywność mobilna. Już od dawna ważne jest dostosowanie strony do urządzeń mobilnych, ale nie chodzi tylko o użycie odpowiednich szablonów lub układów. Sprawdzaj każdą stronę na różnych urządzeniach, ponieważ często zasób internetowy jest profesjonalnie dostosowany, a konkretna strona wyświetla się niepoprawnie na smartfonie czy tablecie z powodu specyficznych bloków czy interaktywnych elementów.

- Uszkodzone linki. Regularnie sprawdzaj stronę za pomocą Screaming Frog (darmowo do 500 URL) lub Ahrefs Webmaster Tools pod kątem braku wewnętrznych linków prowadzących do nieistniejących stron. W 2026 roku głównymi typami duplikatów są kanoniczne i parametryczne, a także duplikaty kategorii i tagów, które często występują na WordPressie.

- Przekierowania. Ich użycie jest normalną praktyką, ale bez łańcuchów, gdy URL prowadzi przez 2-3 pośrednie adresy do końcowego. Zawsze powinno być tylko jedno przekierowanie, to znaczy, że stary adres od razu prowadzi użytkownika na nowy.

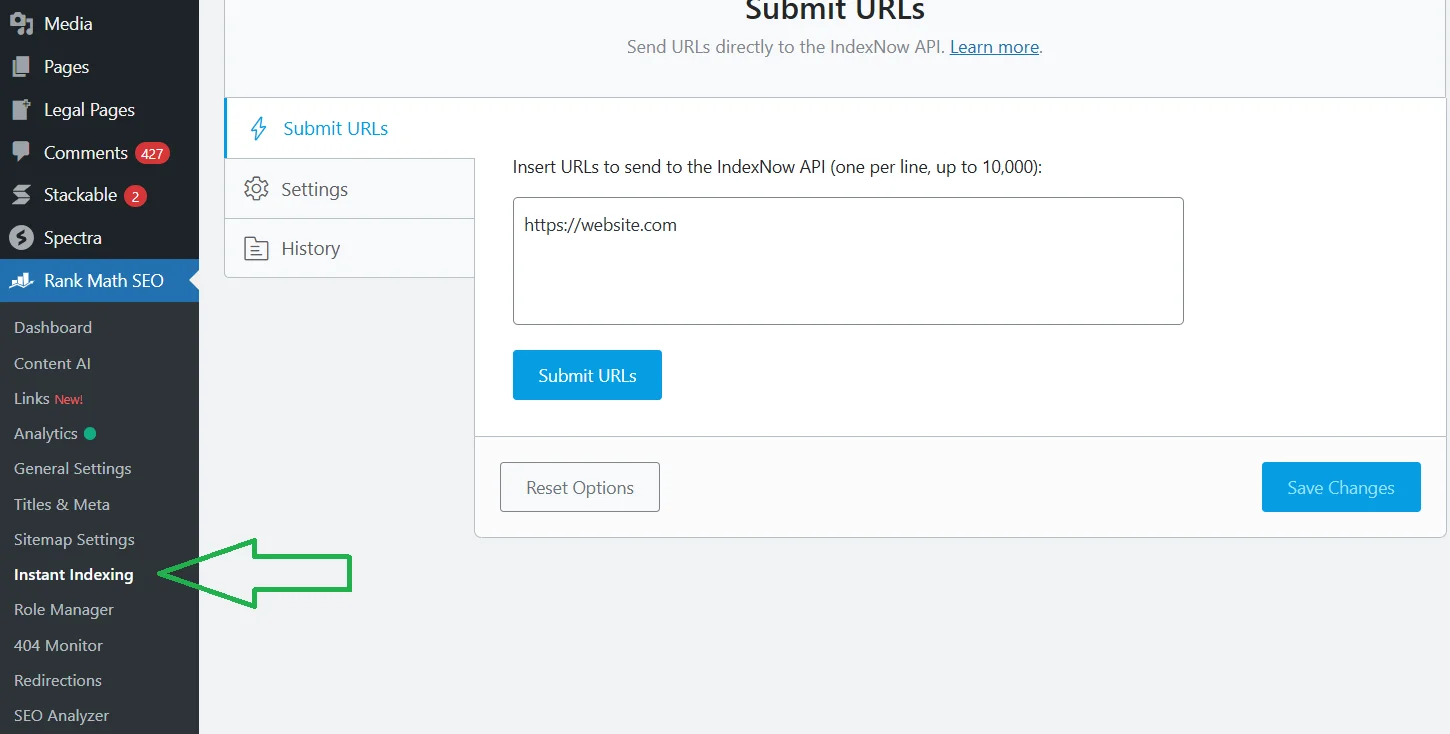

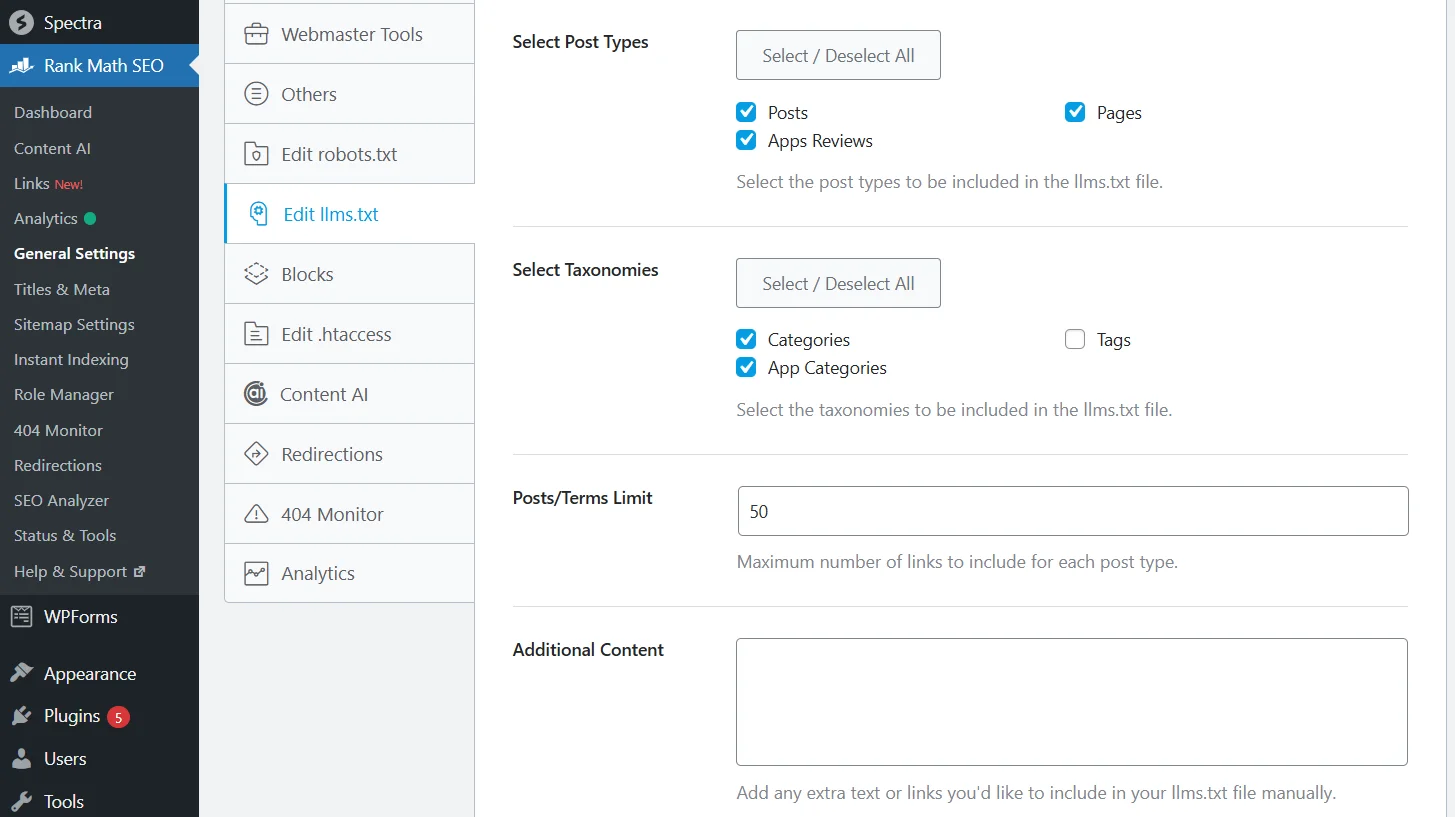

Osobno chcę wyróżnić IndexNow — standard do natychmiastowego powiadamiania zarówno systemów wyszukiwania, jak i AI o aktualizacji treści. Dla właścicieli stron na WordPressie istnieją kompleksowe wtyczki SEO z obsługą tego protokołu. Na przykład, używam darmowej wersji Rank Math, która wspiera natychmiastową indeksację zarówno każdej strony z osobna, jak i dużej liczby razem (do 10 000).

W sekcji Rank Math → Instant Indexing najpierw podajesz listę URL (każdy w nowym wierszu), następnie przesyłasz je do indeksacji i zapisujesz zmiany.

Specjalne wymagania dotyczące Robots.txt w 2026 roku

Stworzenie pliku robots.txt można wykonać w kilka minut za pomocą usług online i wtyczek WordPress, takich jak Rank Math, Yoast, All-in-One. Ale do optymalizacji strony pod sztuczną inteligencję klasyczna zawartość nie wystarczy. Trzeba umieć wyraźnie rozróżniać boty do nauki i boty do wyszukiwania na żywo, aby przypadkowo nie zablokować dostępu do treści przydatnym systemom AI.

Musisz sprawdzić, czy następujące boty AI są dozwolone w robots.txt:

- Google-Extended — Gemini;

- ClaudeBot — Anthropic (Claude);

- PerplexityBot — Perplexity;

- ChatGPT-User i OAI-SearchBot — ChatGPT (właśnie dla użytkowników).

Wiele stron domyślnie blokuje powyższe boty z powodu ustawień bezpieczeństwa, na przykład w Cloudflare. Aby otworzyć im dostęp, wpisz w pliku robots.txt nazwy botów przez «Allow: /».

Niektóre boty AI, które zbierają dane do nauki, lepiej jest zablokować:

- GPTBot;

- Google-CloudVertexBot;

- Bytespider;

- CCBot;

- meta-externalagent;

- Amazon-bot (jeśli nie sprzedajesz produktów na Amazonie i nie masz korzyści z Alexy).

Można zablokować im dostęp również w pliku robots.txt przez «Disallow: /». Tylko ważne jest, aby zrozumieć, że ten plik jest tylko rekomendacją: duże korporacje zazwyczaj przestrzegają tych zasad, a Bytespider i podobne boty — ignorują. Jednak lepiej zamknąć im dostęp i dodatkowo się zabezpieczyć, na przykład z tym samym Cloudflare.

Jak stworzyć plik llms.txt dla sztucznej inteligencji

Stworzenie tego pliku można w standardowym edytorze tekstu, na przykład Notepad lub VS Code. Dokument należy nazwać właśnie llms.txt, a nie LLMS.txt. W nim należy wpisać:

- # Nazwa projektu — główny nagłówek.

- > Krótki opis — istota strony.

- ## Rozdziały.

Następnie zapisujesz plik i umieszczasz go w głównym katalogu strony, gdzie już znajduje się robots.txt. I od razu możesz go sprawdzić pod adresem twojastrona.com/llms.txt. Jeśli projekt jest duży, można stworzyć llms-full.txt, gdzie umieścisz znacznie więcej linków i szczegółowych informacji, podczas gdy główny llms.txt pozostawisz jako zwięzły wstęp.

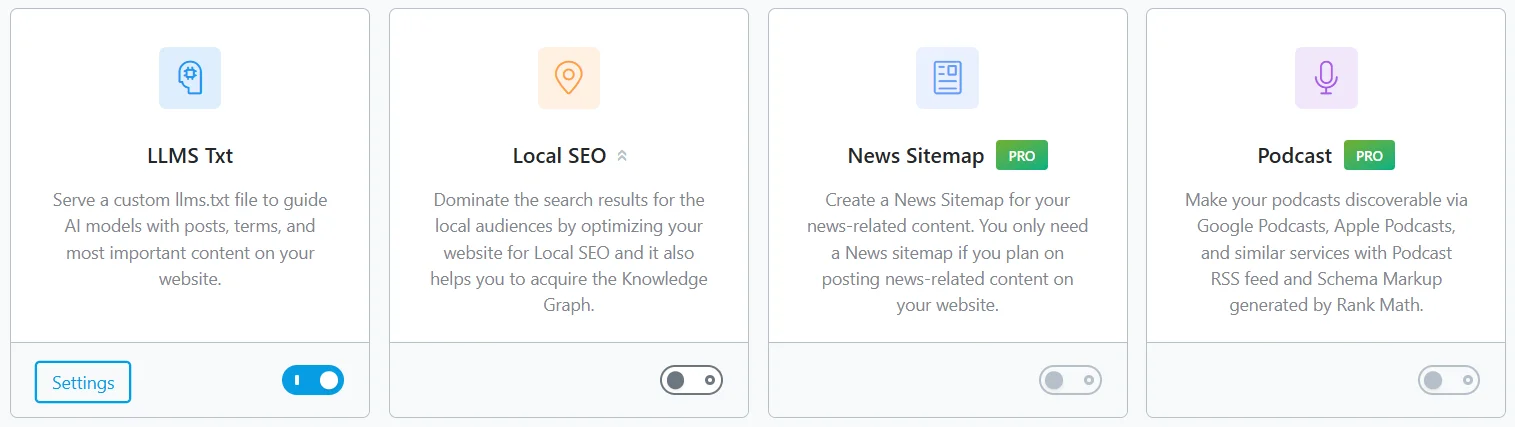

Dla WordPressa istnieje wiele wtyczek do automatycznego tworzenia llms.txt, w tym LLMs.txt Generator oraz Website LLMs.txt. Ponadto klasyczne wtyczki do optymalizacji wyszukiwania strony również wspierają ten plik. Używam właśnie modułu dla Rank Math — LLMS Txt.

Moduł dostępny jest w darmowej wersji z natychmiastową aktywacją.

LLMS Txt od Rank Math wspiera zarówno standardowe, jak i niestandardowe typy wpisów.

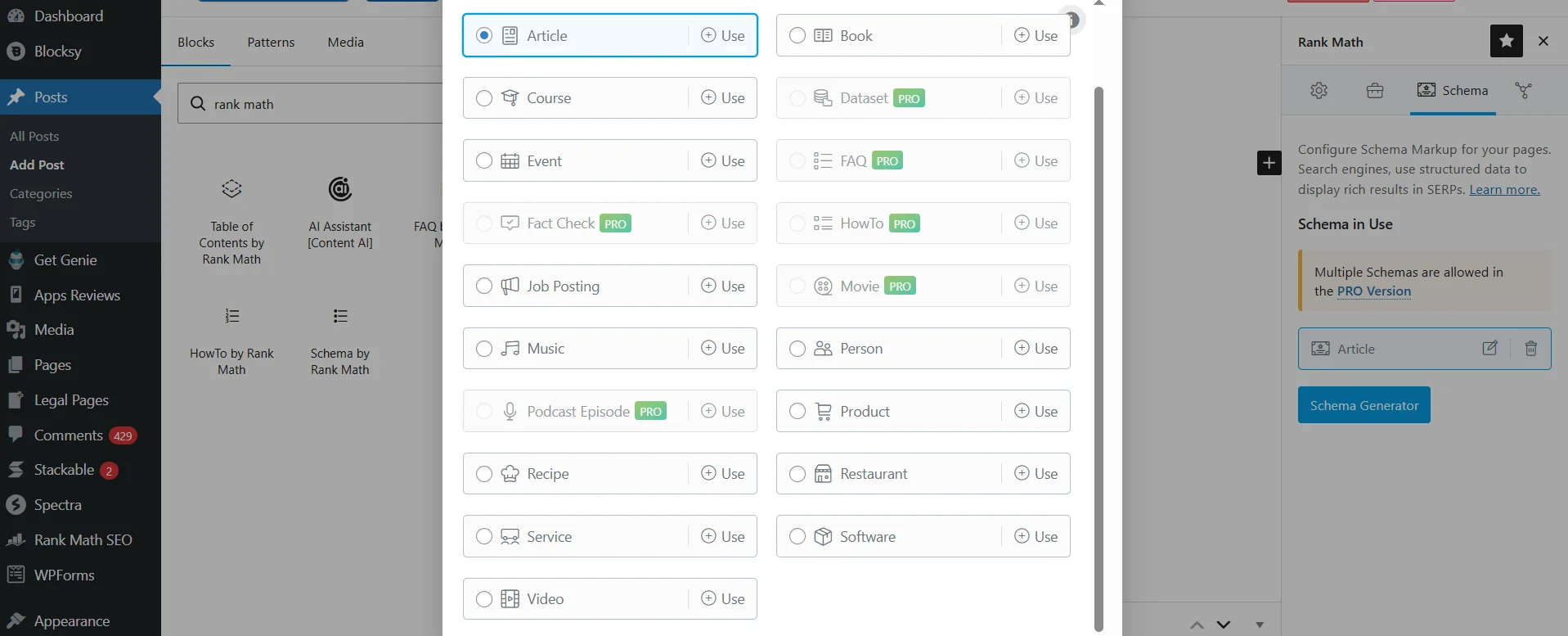

Jak skonfigurować mikroformat Schema.org dla systemów AI

W klasycznym SEO Schema pomagała uzyskać rozszerzone fragmenty w wynikach, aby wyróżnić się wśród konkurencji. W epoce sztucznej inteligencji mikroformat stał się jeszcze ważniejszy, ponieważ pozwala AI jednoznacznie zrozumieć typ treści.

Do podstawowych typów Schema należy:

- FAQPage — bezpośrednie źródło do formowania odpowiedzi AI, odpowiednio, najlepszy sposób na uzyskiwanie wzmianków i linków z odpowiedzi sztucznej inteligencji.

- Organization — ustala tożsamość marki, w tym logo, dane kontaktowe i media społecznościowe firmy.

- Article — standardowy mikroformat dla wpisów, który musi zawierać pola dateModified (AI zwraca szczególną uwagę na aktualność danych) oraz author z linkiem do profilu eksperta.

- Review — przydatny format, który wykorzystuję do recenzji.

- Product — niezwykle ważny dla e-commerce, ponieważ pozwala AI wyciągać dane o cenie, dostępności i opiniach do porównania produktów.

Do generowania mikroformatów można używać oficjalnego narzędzia Schema.org Generator. Jeśli chcesz uprościć proces, warto użyć jednej z popularnych wtyczek SEO, na przykład tej samej Rank Math.

Jednak tutaj już będziesz musiał zmierzyć się z ograniczeniami darmowej wersji: część schematów dostępna jest tylko w płatnej wersji, plus czysto technicznie nie można dodać 2-3 i więcej formatów. Ale jeśli wstawisz na przykład pytania i odpowiedzi przez FAQ by Rank Math bezpośrednio na stronę, to wszystko jest konfigurowane i indeksowane. Tylko nie zapominaj sprawdzać wyników w Rich Results Test, aby upewnić się, że dane są odczytywane poprawnie.

Przeczytaj także: Najlepsze usługi AI dla SEO: optymalizacja strony bez zbędnego wysiłku

Jak optymalizować treści dla systemów AI

Aby stworzyć treść, która będzie cytowana przez systemy AI, trzeba przejść od myśli «Jakie słowa kluczowe wpisują ludzie?» do «Jakie pytania zadają użytkownicy — i jaką dokładną odpowiedź oczekują?». Twoim celem jest stworzenie autonomicznego bloku tekstu, który sztuczna inteligencja będzie mogła wyciągnąć ze strony i wstawić w odpowiedzi użytkownikowi bez poprawek.

W tym celu należy używać nowoczesnej struktury treści:

- Nagłówek H2 w formie powszechnego zapytania użytkowników. Na przykład, «Jak obliczyć moc klimatyzatora?».

- Bezpośrednia odpowiedź od razu pod nagłówkiem, bez długich wstępów. Na przykład, «Powierzchnię pokoju należy podzielić przez 10. Odpowiednio, jeśli to pokój 20 m², potrzebny jest klimatyzator na 2 kW, 40 m² — 4 kW».

- Głęboka szczegółowość, gdzie dodajesz unikalne dane, własne przypadki lub profesjonalne niuanse. Na przykład, «Dla lepszej dokładności nie należy ignorować dodatkowych źródeł ciepła. Z własnego doświadczenia mogę powiedzieć, że dodanie po 0,1 kW na każdą osobę i 0,5 kW na sprzęt pozwala…».

Oprócz struktury bloków, ważne jest, jak wygląda sam tekst. Systemy AI znacznie łatwiej przetwarzają i częściej cytują materiały, które zawierają akapity z 3-5 zdań, numerowane i wypunktowane listy, tabele.

Dlaczego osobiste doświadczenie stało się obowiązkowym wymogiem

W latach 2023-2025 systemy AI zmierzyły się z masowym napływem jednolitych treści, generowanych przez same AI. W odpowiedzi modele zaczęły wyraźnie faworyzować źródła z sygnałami rzeczywistego ludzkiego doświadczenia. Dlatego, pomimo znaczenia konkretów, szczególnie w pierwszym akapicie po podtytule, twoja strona nie powinna stać się encyklopedią, ponieważ takie zasoby internetowe po prostu nie wytrzymają konkurencji ze sztuczną inteligencją.

Przeciwnie, osobiste doświadczenie jest teraz krytycznie ważne zarówno dla ludzi, jak i dla AI. Potwierdza to koncepcja E-E-A-T, gdzie pierwsza «E» — Experience (doświadczenie) — pojawiła się w 2022 roku jako odpowiedź Google na wzrost bezosobowej treści. Sztuczna inteligencja przyjęła tę samą zasadę selekcji wiarygodnych źródeł do cytowania: materiał bez autora i bez doświadczenia nie może być uważany za wiarygodne źródło.

Pokazać swoje doświadczenie i ekspertyzę na stronie można za pomocą:

- Strony autora. Teraz nie wystarczy po prostu umieścić imienia pod artykułem. Ważne, aby autor miał osobną stronę, na której podana jest jego specjalizacja, doświadczenie, wykształcenie, przykłady rzeczywistych projektów lub publikacji.

- Podpisu autora. Pod każdym materiałem powinien być blok autora z zdjęciem, imieniem, krótkim bio i linkiem do tej strony. I to dotyczy nie tylko blogów czy czasopism online, ale także firm: wybierz kilku członków zespołu, stwórz im profile i publikuj w ich imieniu.

- Pierwszej osoby. Jak już mówiłem, nie trzeba robić ze swojego artykułu osobistego dziennika, ale tam, gdzie to stosowne — należy pokazać doświadczenie. Na przykład, «Testowałem 5 dostawców hostingu przez miesiąc i wybrałem najlepszy niedrogi i niezawodny hosting dla strony» lub «Ten powerbank spadał mi dziesiątki razy, a z zewnątrz wygląda jak nowy».

- Dat publikacji i aktualizacji. Systemy AI działające w czasie rzeczywistym uwzględniają aktualność źródła. Artykuł, który został zaktualizowany 3 miesiące temu, otrzyma priorytet nad materiałem z ostatnią aktualizacją w 2023 roku.

Tak więc treść, która jest cytowana przez AI, opiera się na przecięciu trzech rzeczy: wyraźnej struktury do szybkiego wyciągania odpowiedzi, rzeczywistego doświadczenia jako sygnału wiarygodności źródła, żywego głosu autora, za którym ludzie chcą wracać na stronę.

Przeczytaj także: Co to jest tone of voice — jakim tonem marka powinna mówić do swojej publiczności

Off-Page GEO: od linków do reputacji

W ciągu ostatnich dwóch lat nastąpiły ważne zmiany w podejściu do zewnętrznej optymalizacji zarówno ze strony wyszukiwarek, jak i sztucznej inteligencji. Wcześniej linki pełniły jedną funkcję — przekazywały «wagę» z jednej domeny do drugiej, a algorytm liczył liczbę i jakość tych powiązań. W 2026 roku linki pozostają ważne, ale dla AI są raczej jednym z dowodów wiarygodności źródła, niż kluczowym kryterium jego wyboru.

W rezultacie już znane typy Off-Page SEO stały się równie ważne dla sztucznej inteligencji:

- Wzmianki o marce. Gdy autorytatywne wydanie pisze «według danych Cityhost» lub «jak zauważa content marketer Cityhost Bohdana Hajvoronska» — systemy AI rejestrują to jako sygnał rozpoznawalności i wiarygodności marki. I jedna taka wzmianka bez linku jest ważniejsza niż 10 słabych backlinków.

- Cytaty na zasobach o wysokim autorytecie domeny. Backlinki z branżowych wydawnictw z DA 70+ są nadal ważne, ale ich wartość znacznie wzrosła. Lepiej zdobyć kilka takich linków, niż setki z katalogów.

- Autorytet autora. W klasycznym SEO autorytet domeny i autora były w zasadzie tym samym. W GEO — to dwa różne sygnały, i oba są ważne. Jeśli twój autor jest gdzieś cytowany lub pisze artykuły pod swoim imieniem dla innych wydawnictw, to jego treść na twojej stronie może mieć świetny boost.

Uzyskiwanie wzmianków o stronie można na Reddit i Quora, biorąc udział w branżowych dyskusjach i odpowiadając na tematyczne pytania. Efektywną platformą do uzyskiwania zarówno wagi linków, jak i tematycznego cytowania jest Medium: zakładasz konto i piszesz artykuły na podobne do twojej strony tematy, a wewnątrz wstawiasz linki (lepiej nie spamować, jeden-dwa wystarczą) i wspominasz swój projekt internetowy lub firmę. Chociaż ukraińska społeczność na Medium stale rośnie, konkurencja i tak pozostaje niska, szczególnie w porównaniu do anglojęzycznego segmentu.

Czy warto w ogóle optymalizować stronę pod sztuczną inteligencję

Tak, ale nie rób z tego czegoś wielkiego, jednocześnie panikując, że «SEO umiera». Umiera od 2003 roku, gdy Google wprowadził aktualizację Florida i od 2011 roku z aktualizacją Panda — rozpoczął walkę z duplikowanym i słabym kontentem. I w ostatnich latach miało miejsce wiele zmian i nowych aktualizacji, sztuczna inteligencja rzeczywiście zabrała dużą część ruchu, ale jednocześnie przyniosła wyższą jakość.

Zgodnie z danymi Superprompt na 2025 rok, wyszukiwanie AI konwertuje znacznie lepiej niż tradycyjne organiczne wyszukiwanie. Na przykład, konwersja z Google wynosi średnio 2,8%, podczas gdy Perplexity — 12,4%, ChatGPT — 14,2%, a Claude — 16,8%. Użytkownik, który trafił do ciebie przez Perplexity lub ChatGPT, pięć razy częściej wykona działanie docelowe, na przykład kupi produkt lub skorzysta z usługi, niż osoba z Google.

Jednak interesujące jest to, że dobre klasyczne SEO wciąż jest najlepszą strategią, aby znaleźć się w odpowiedzi AI: zgodnie z danymi Ahrefs na 2025 rok, 76,1% URL, które są cytowane w Google AI Overviews, również zajmują miejsce w TOP 10 Google dla tego samego zapytania. To znaczy, że sam fundament w postaci optymalizacji wyszukiwania stron pozostaje, a do niego dodawane są specyficzne wymagania systemów AI, o których już mówiliśmy:

- Podstawa techniczna prawie się nie zmieniła. Indeksacja, szybkość, struktura — wciąż krytycznie ważne.

- Treść stała się bardziej zorganizowana i złożona — od słów kluczowych do intencji i pytań, od anonimowego tekstu do weryfikowanego doświadczenia autora.

- Zewnętrzne SEO przesunęło się z «backlinków jako zwiększenia wagi linków» do «linków zwrotnych jako podniesienia autorytetu strony».

Kluczowe zasady (autorytet, struktura, doświadczenie, dostępność techniczna) działają jednocześnie na wszystkich platformach, niezależnie od tego, czy to Google, ChatGPT czy Claude. Wszyscy rozwiązują to samo zadanie: znaleźć wiarygodne źródło odpowiedzi na zapytanie człowieka. Jeśli będziesz zrozumiały i pomocny dla swojej docelowej publiczności, a co najważniejsze — gotowy podzielić się własnym doświadczeniem, to będziesz mógł uzyskiwać ruch zarówno z wyszukiwarek, jak i z systemów AI.